Ce que les Droits de l'Homme ont à redouter des algorithmes

Classer, ordonner, ranger, trier : les algorithmes occupent l’espace numérique à grande vitesse. Ces outils mathématiques en mesure de résoudre des opérations qui se complexifient avec le temps bousculent les habitudes. Dans le privé, comme le public, ils sélectionnent, recommandent, voire choisissent. Mais avec quelles conséquences ?

Le 26/09/2019 à 09:46 par Clément Solym

1 Réactions | 2 Partages

Publié le :

26/09/2019 à 09:46

1

Commentaires

2

Partages

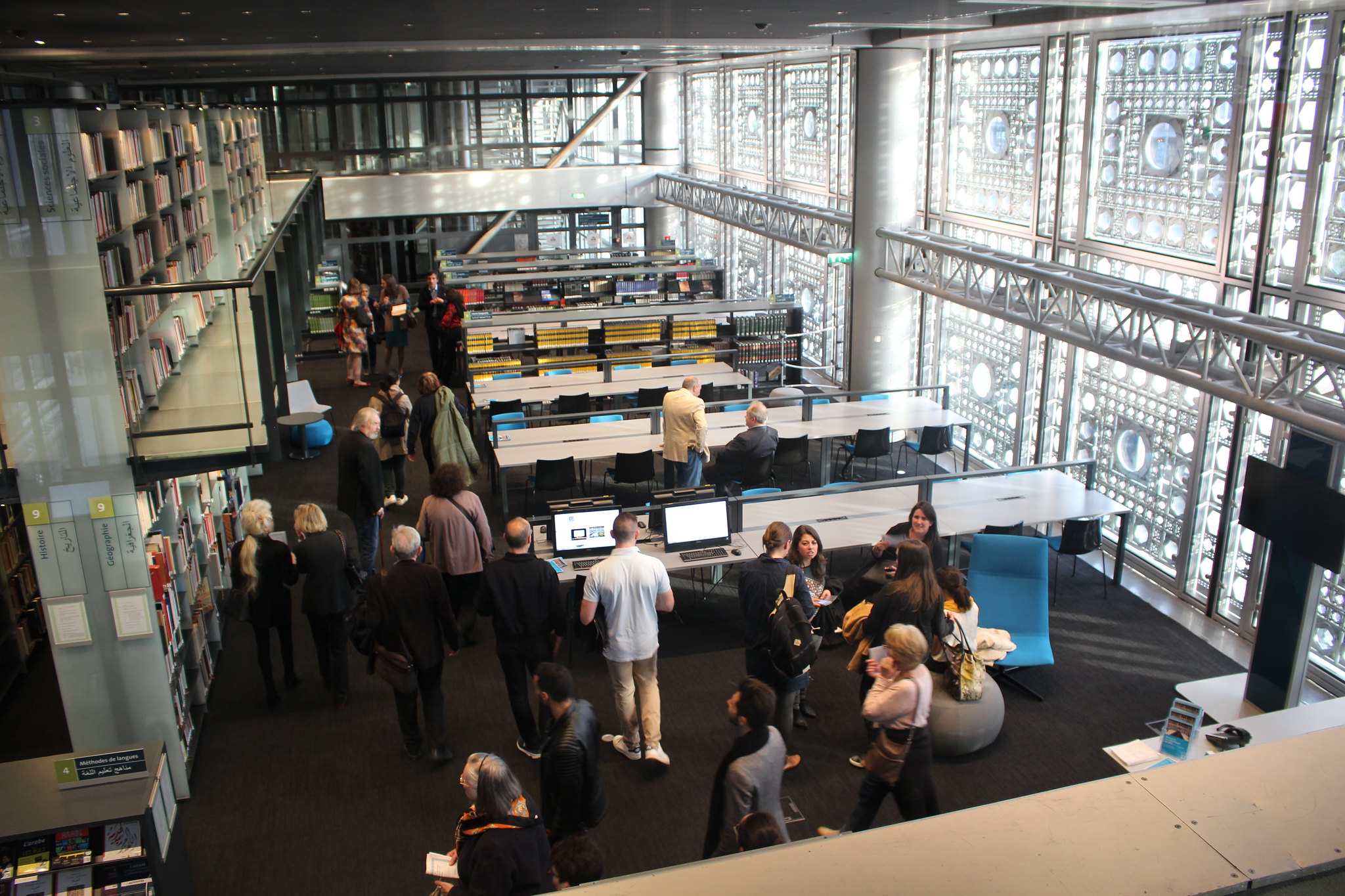

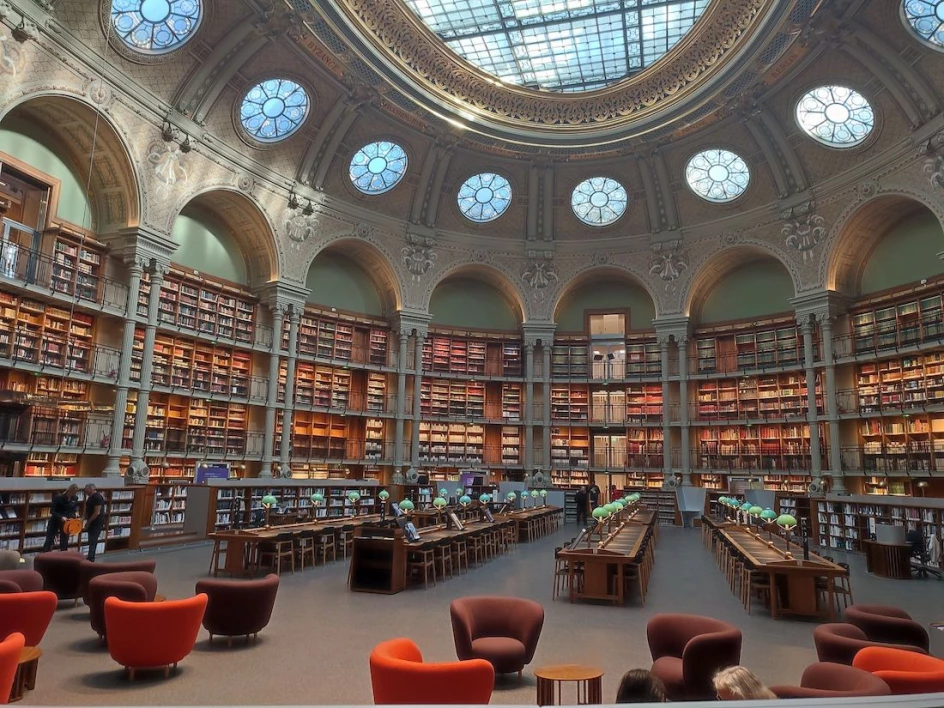

Le Conseil de l’Europe avait sollicité l’avis du public, en juillet dernier : chacun pouvait apporter ses commentaires et recommandations sur la thématique définie. La Fédération internationale des associations et institutions de bibliothèques (IFLA) s’est rapidement emparée du sujet, tant il est au cœur des préoccupations pour les établissements de prêt.

Protéger le public des données collectées

Alors, quelle est l’incidence des systèmes algorithmiques sur les Droits de l’Homme ? Originellement le Conseil interrogeait tout un chacun, dans la perspective d’un projet de texte, qui serait adopté par le Comité des ministres, début 2020. Mais farfouiller dans les alogirthmes n’est pas sans risques, tant ces outils tentaculaires peuvent « affecter les droits de l’homme et les libertés fondamentales », rappelle-t-on.

Bien entendu, confier à la machine des tâches que l’humain n’exécuterait que laborieusement, avec un risque d’erreur accru, relève de l’évolution. Les avantages se comptent aisément : amélioration des vitesses de calcul, efficacité accrue des services, et autant d’atouts qui pourraient même remplir les nécessités que fixent les Droits de l’Homme.

Ou comment la collecte et le traitement de données permettraient de prendre des décisions primordiales concernant la planète et le climat, par exemple…

Le projet de recommandations sur lequel planche le Conseil de l’Europe porte sur deux axes : l’un à destination des États, l’autre pour les opérateurs privés. Ces recommandations porteront donc sur des approches législatives, réglementaires, autant que des programmes d’éducation aux algos, des mesures d’impact, de bonnes pratiques, couplées à des approches autour de la recherche et du développement.

Des machines en bibliothèques

Le recours aux algorithmes dans une bibliothèque apparaîtrait faussement contradictoire, souligne d’ailleurs l’IFLA. Pour autant, les outils de calculs mettent en péril plusieurs des valeurs défendues âprement par les établissements : liberté intellectuelle, accès à l’information, autonomisation et non-discrimination.

Dans un document de réponse (à consulter et télécharger en fin d’article), l’IFLA développe donc ces différents points avec une idée précise : les algorithmes sont, en premier lieu, des solutions susceptibles d’affecter l’autonomie informationnelle des individus et leur liberté de pensée. À ce titre, de nombreux établissements ont démontré comment faire coexister des services numériques (dont des algos) avec des solutions analogiques.

L’autre point est d’ordre budgétaire : les machines coûtent cher, et l’on ne peut demander aux établissements de soutenir économiquement ces évolutions, sans les aider eux-mêmes.

Par ailleurs, l’IFLA insiste sur l’impératif d’une formation, pour « que les personnes puissent faire des choix en connaissance de cause et exercer leurs droits fondamentaux dans des contextes algorithmiques ».

À ce titre, les bibliothèques pourront aisément servir de relais : l’absence de barrière pour entrer dans un établissement et profiter des ressources mises à disposition sera un atout véritable dans la formation des usagers. Et la multiplication des initiatives et initiations au numérique, comme aux médias, proposés dans ces lieux, permet de puiser dans un large bassin d’expérimentations…

Plus d'articles sur le même thème

À la BnF, pas de pudding, mais des livres à l'arsenic

En mars dernier, la bibliothèque universitaire de Bielefeld, dans le Nord-Est de la Rhénanie-du-Nord–Westphalie (Allemagne), procédait à un gigantesque inventaire pour mettre la main sur des ouvrages empoisonnés... En cause, un colorant à base d'arsenic, potentiellement dangereux. D'autres institutions patrimoniales dans le monde en possèdent, dont la Bibliothèque nationale de France...

23/04/2024, 15:30

L'immense collection de VHS de Scorsese entre à la bibliothèque

52 mètres linéaires, et autant de boîtes de conservation. À la tête d'une des filmographies les plus imposantes de l'histoire, le réalisateur américain Martin Scorsese a pourtant trouvé le temps, des années 1980 aux années 2000, de s'adonner à une occupation pour le moins étrange. Il a enregistré des milliers d'heures de programmes télévisés sur des centaines de VHS...

19/04/2024, 12:36

Argentine : une pétition pour sauver les emplois de la Bibliothèque nationale

Les premiers mois de Javier Milei à la présidence argentine l'ont montré : si son dada, c'est la libéralisation de l'économie, présentée comme un remède à l'inflation record, la défense de la culture n'est pas sa priorité. Preuve éclatante : il a supprimé son ministère dédié... Après avoir ciblé la loi sur le prix unique du livre, appliquée depuis 2001, c'est la Bibliothèque nationale Mariano Moreno qui est dans son viseur, avec le licenciement annoncé d'une bonne partie de ses effectifs...

29/03/2024, 16:00

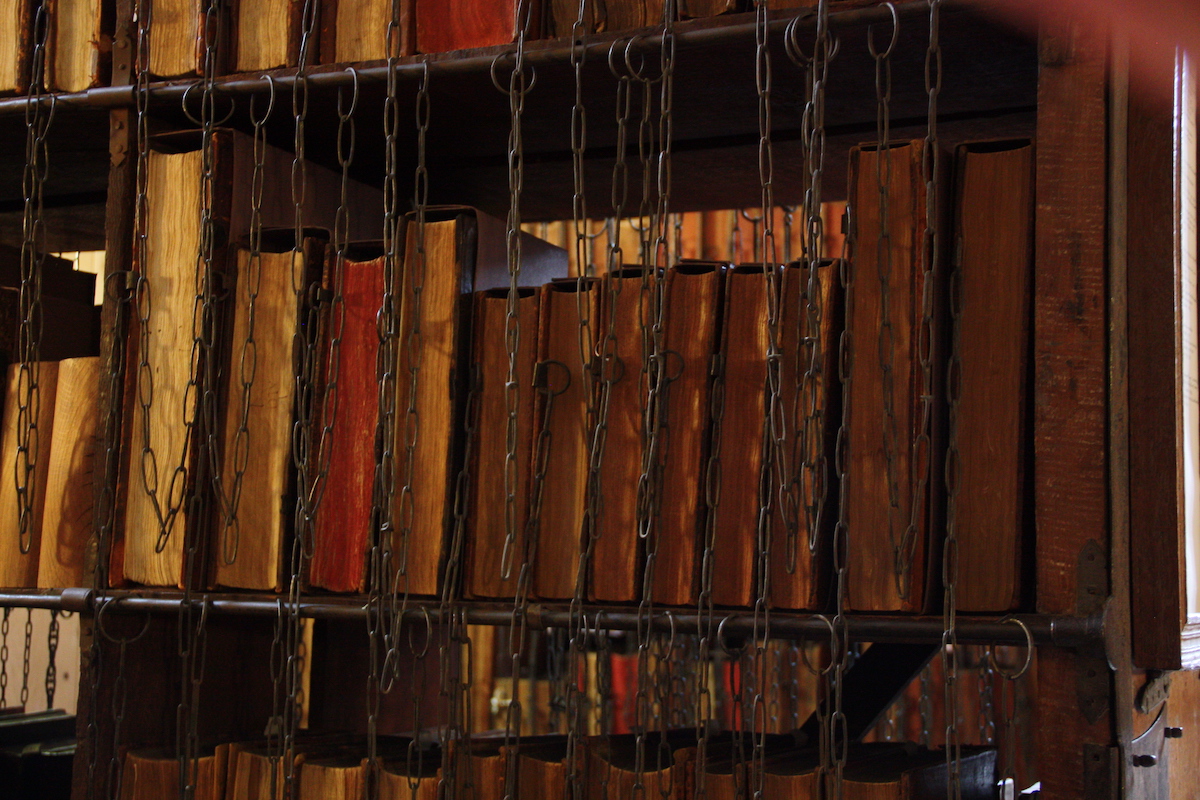

Par “respect”, Harvard retire un livre en peau humaine de sa bibliothèque

En 2014, Harvard confirmait, après une analyse scientifique en bonne et due forme, une suspicion : ses collections renfermaient bien un livre relié avec de la peau humaine. Des destinées de l'âme d'Arsène Houssaye (1880) a été recouvert par la peau d'une femme anonyme, à la demande du médecin et bibliophile français Ludovic Bouland (1839-1932). L'université ne propose plus de consultation de l'ouvrage, et cherche désormais à restituer ces restes humains.

29/03/2024, 14:15

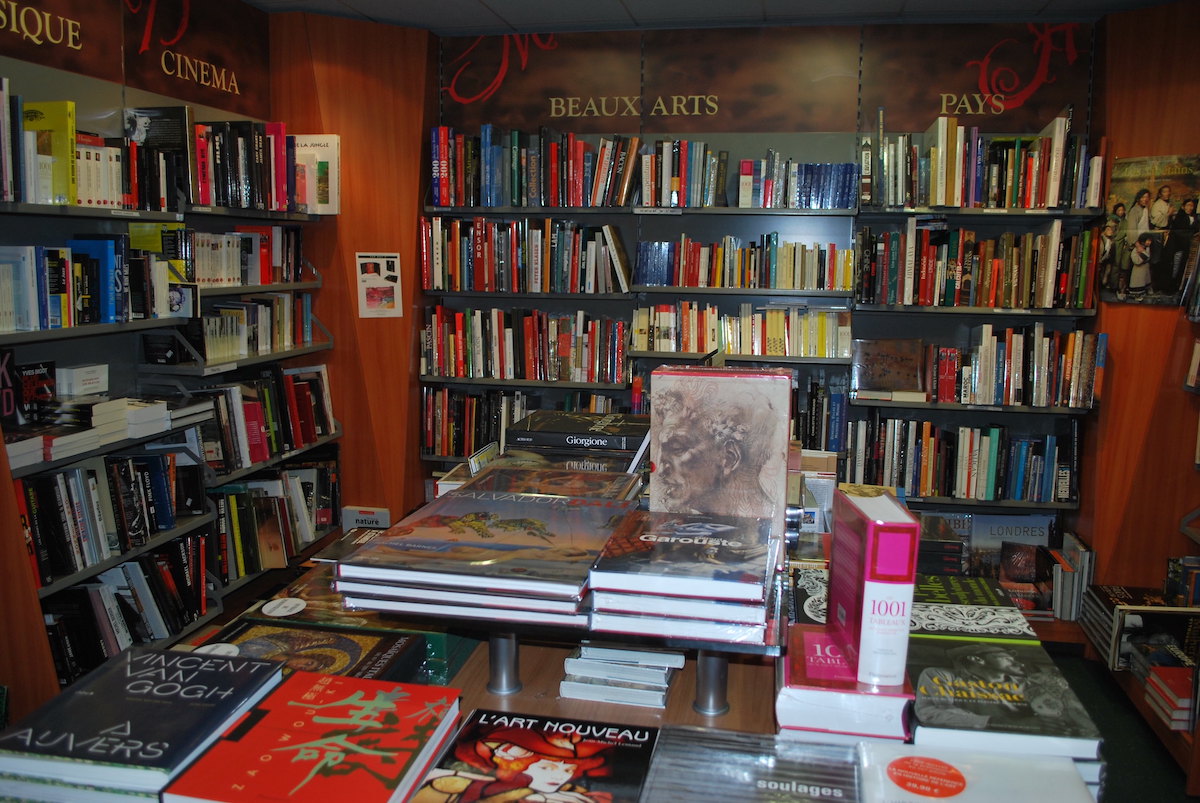

Grand Est : bibliothèques et librairies, une proximité salvatrice

Dans la région Grand Est, les bibliothèques et librairies constituent de véritables équipements culturels de proximité : sans elles, l'accès à la culture serait considérablement amoindri. Ces lieux représentent près de 80 % des équipements culturels du territoire, un chiffre par ailleurs comparable à celui de la « France de province », selon l'Institut national de la statistique et des études économiques (Insee).

29/03/2024, 09:24

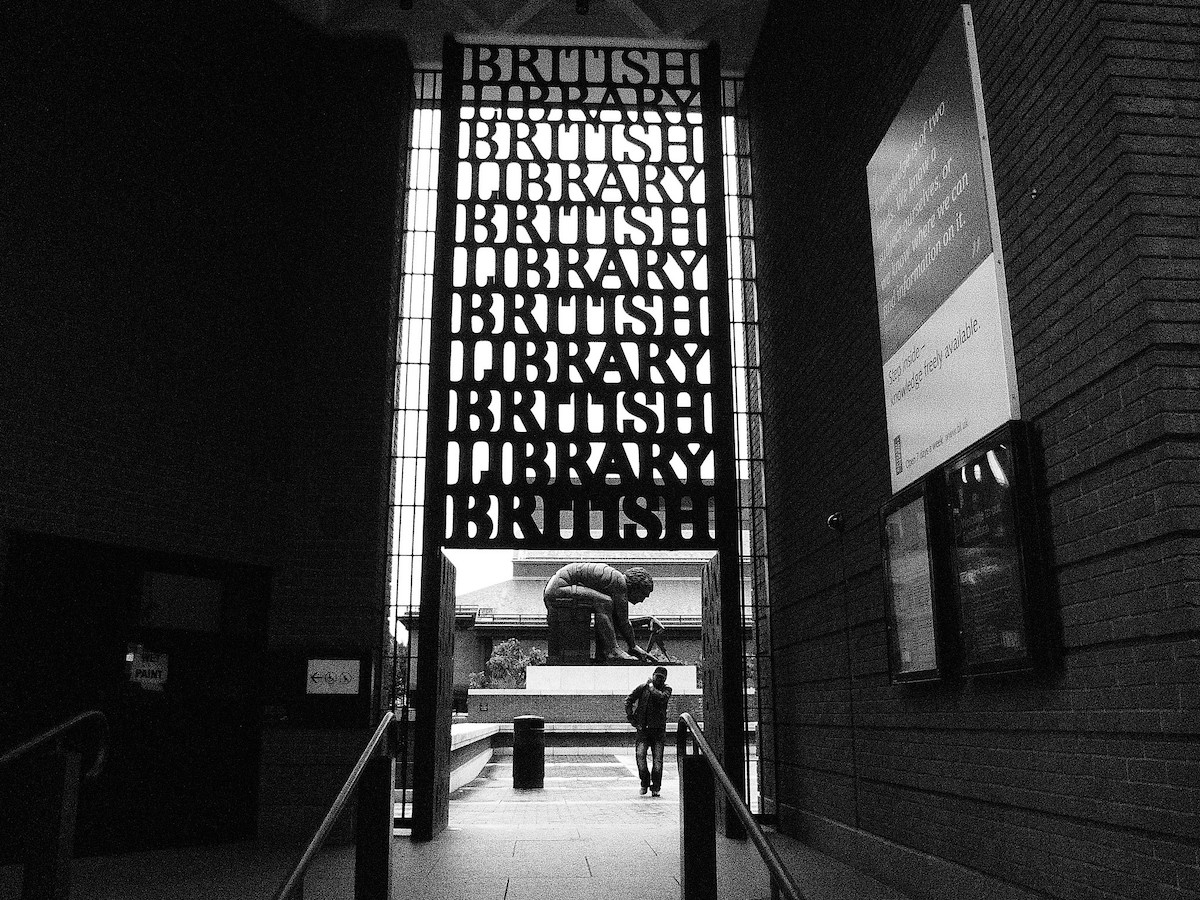

Attaque de la British Library : 600 Go partis sur le dark web

Six mois après une cyberattaque dévastatrice, la British Library retrouve petit à petit la maitrise de l'ensemble de ses services. Si le coût total des réparations n'est pas encore arrêté, il se chiffrera sans doute en millions £ : l'institution a livré ses observations sur l'incident, et tiré quelques leçons utiles pour l'avenir...

26/03/2024, 10:50

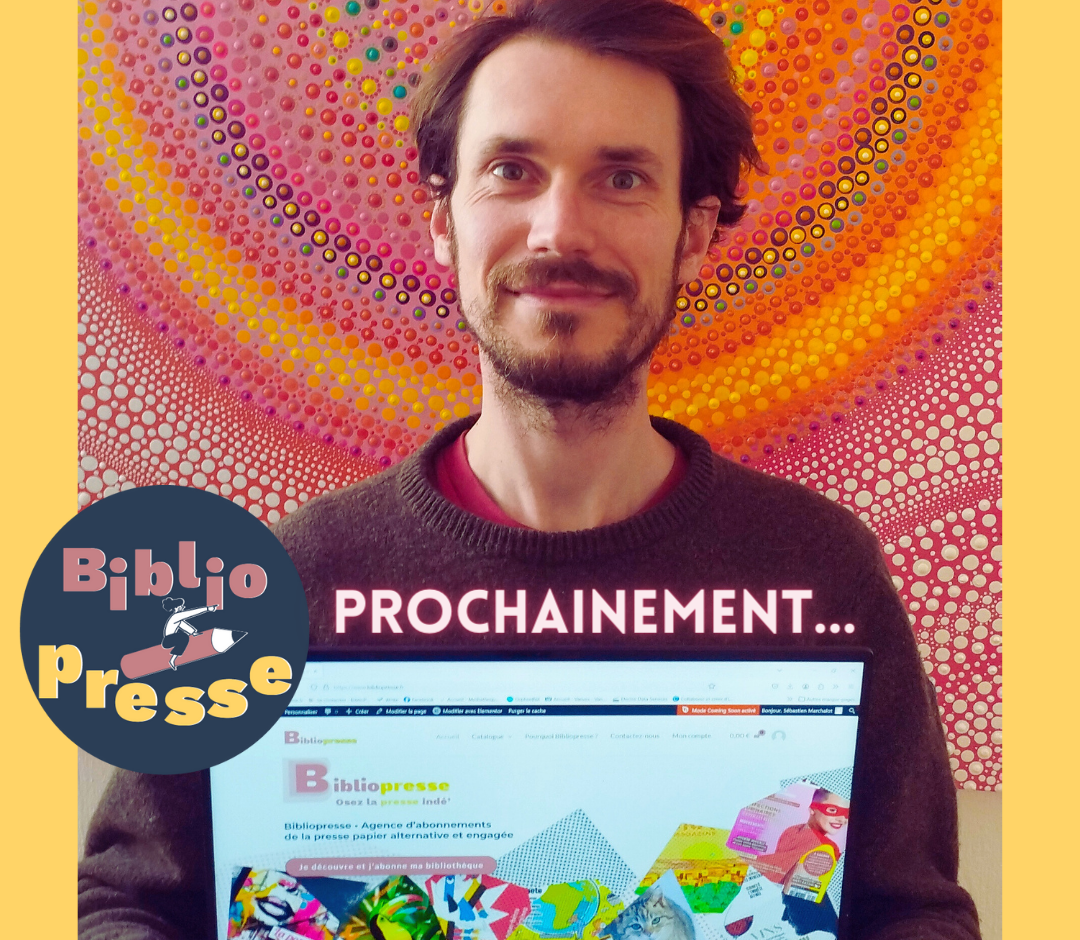

Bibliopresse : redéfinir la presse en bibliothèque

Bibliothécaire durant une douzaine d'années, et engagé dans la défense de l'indépendance en édition, Sébastien Marchalot lance son offre à destination des bibliothèques municipales et départementales, Bibliopresse. Le concept : réunir les titres de la presse papier indépendante française, afin de les défendre auprès des acteurs publics de la lecture gratuite, dans un contexte de baisses du lectorat papier et des budgets des collectivités.

25/03/2024, 17:00

Professionnels des bibliothèques : formation, concours et métiers

Le ministère de la Culture a publié deux nouveaux guides élaborés en concertation avec plusieurs partenaires du monde des bibliothèques — ainsi que le ministère de l’Enseignement supérieur et de la Recherche et l’Inspection générale de l’éducation, du sport et de la recherche.

21/03/2024, 12:40

Dans les bibliothèques, les acquisitions font-elles les emprunts ?

Publié en ce début d'année 2024, l'Atlas des bibliothèques territoriales s'appuie sur des données de 2021 pour esquisser un panorama des établissements de lecture publique, depuis différents points de vue. Il s'intéresse notamment à la dynamique des acquisitions et aux moyens alloués, décisifs pour l'attractivité des bibliothèques.

19/03/2024, 11:21

Nogent-sur-Marne : la Bibliothèque Smith-Lesouëf devient “Maison des Illustres”

En 1906, les sœurs Madeleine Smith-Champion et Jeanne Smith héritent de la collection de livres de leur oncle, Auguste Lesouëf. Soit 18.000 ouvrages tout de même, dont des manuscrits rares et quelques incunables. La Bibliothèque Smith-Lesouëf, plus d'un siècle plus tard, est labellisée « Maison des Illustres », gage de son importance patrimoniale.

04/03/2024, 12:49

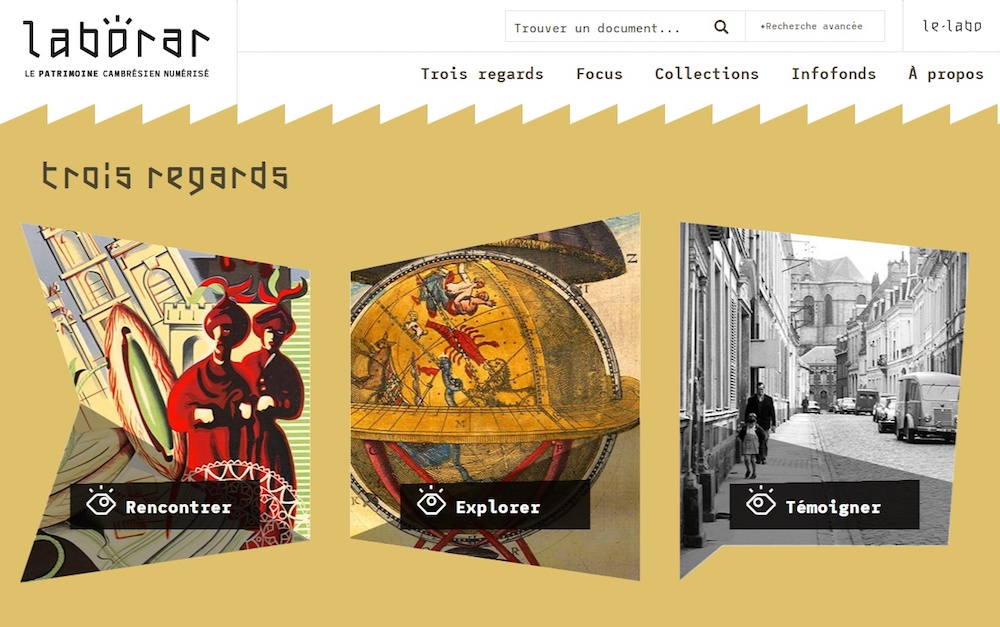

Laborar : le patrimoine cambrésien rassemblé sur un site dédié

Le 1er mars 2024, Laborar, la bibliothèque numérique patrimoniale de Cambrai, a entamé un nouveau chapitre de son histoire en rejoignant le programme « Gallica marque blanche » de la Bibliothèque nationale de France (BnF).

04/03/2024, 12:49

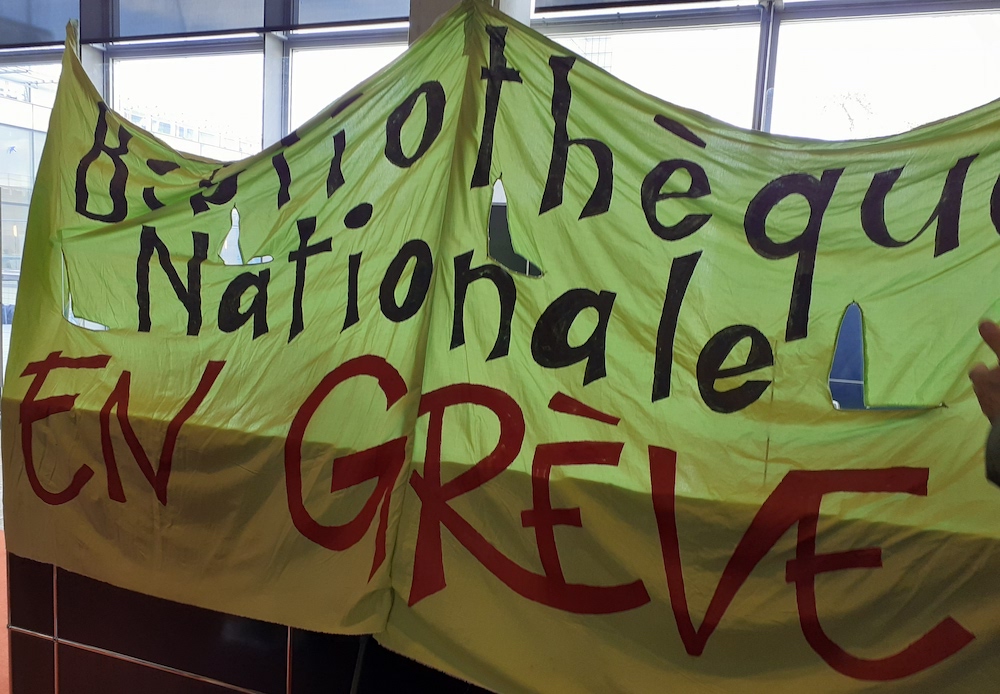

BnF : un préavis de grève pour l'égalité homme-femme

La CGT BnF et la section SUD Culture Solidaires de la bibliothèque ont déposé un préavis de grève, concernant tous les employés de l'institution, prévu pour le vendredi 8 mars 2024, de l'ouverture à la fermeture des services. Il s'inscrit dans le cadre de la journée internationale de lutte pour les droits des femmes, et vise notamment à mettre sur la table la question du congé menstruel, récemment retoquée par le Sénat.

01/03/2024, 14:47

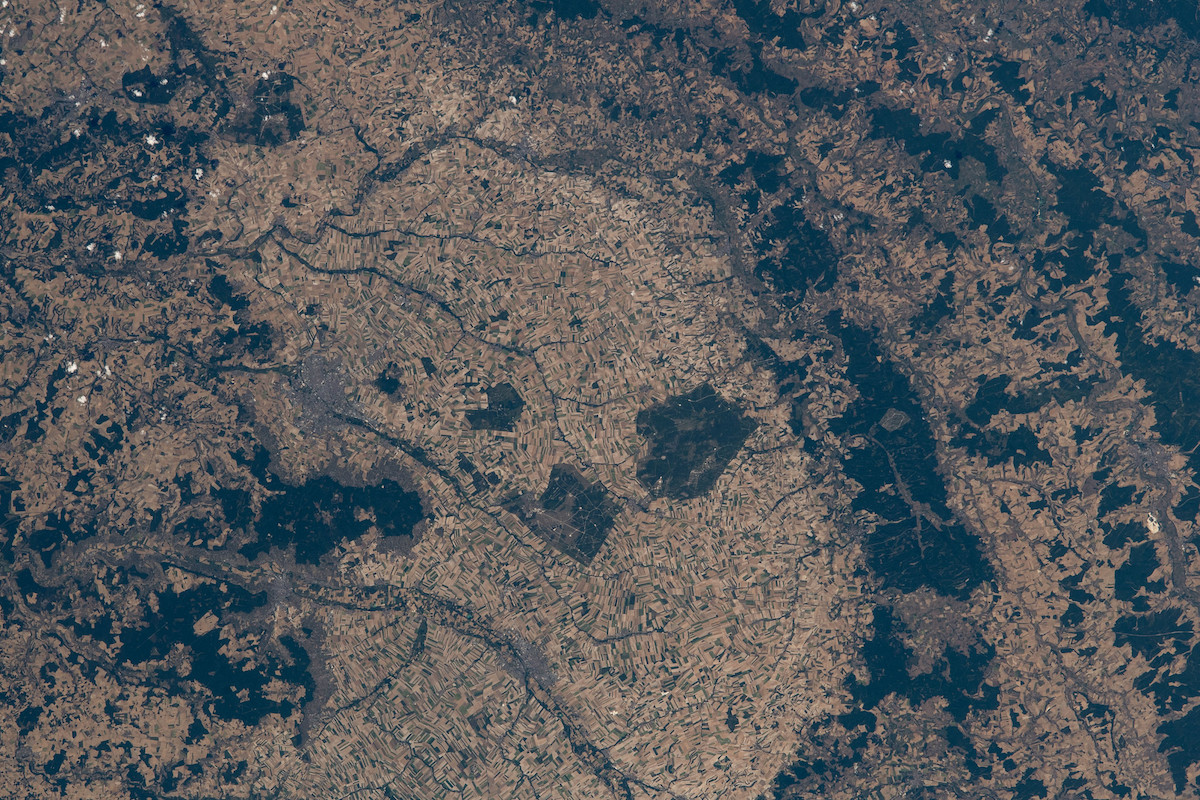

Les bibliothèques françaises, vraiment proches de la population ?

Né d'une collaboration entre le Centre national de la recherche scientifique et le service Livre et Lecture du ministère de la Culture, un Atlas cartographie pour la première fois, de manière précise et selon différents critères, les 15.500 lieux de lecture de l’ensemble du territoire métropolitain et de l’outre-mer. Il renseigne notamment sur la répartition de l'offre, et sa proximité avec les populations...

29/02/2024, 12:07

L'Association des lecteurs et usagers de la BnF n'est plus la bienvenue

L'Association des lecteurs et usagers de la Bibliothèque nationale de France (ALUBnF) définitivement persona non grata à la Bibliothèque nationale de France (BnF) ? La première révèle ce début février avoir été « dédomiciliée », du site de Tolbiac par l'institution, « afin d'éviter toute ambiguïté sur les liens existants entre notre établissement et votre association ». C'était l'adresse de l'ALUBnF depuis 2014, sauf qu'en 2022, l'opposition de cette dernière à la restriction des communications décidée par la direction, est allée jusque devant les tribunaux. Alors, vengeance ?

14/02/2024, 18:14

Une bibliothèque municipale, combien ça coûte ?

L'Observatoire des finances et de la gestion publique locales (OFGL), chargé d'informer gouvernement et Parlement de la réalité des finances des collectivités, s'est penché sur les établissements de lecture publique. Bibliothèques municipales ont été passées au crible, pour dégager des indicateurs relatifs aux dépenses (et un peu aux recettes).

12/02/2024, 12:05

Dans les bibliothèques allemandes, l'extrême droite pullule

Il aura fallu le dévoilement d'un plan massif de déportation de citoyens allemands jugés « indésirables », mis au point par l'AfD (Alternative für Deutschland), des entrepreneurs et des néonazis, pour que la population se réveille. D’énormes manifestations ont dénoncé l'idéologie haineuse de l'extrême droite, qui s'est déjà frayée un chemin jusqu'aux bibliothèques publiques du pays.

09/02/2024, 11:10

En faire voir de toutes les couleurs aux collections patrimoniales

Initié en 2016 par la bibliothèque de l'Académie de médecine de New York, le festival #ColorOurCollections est une célébration annuelle du coloriage et du patrimoine qui se déroule sur les réseaux sociaux. Pendant cet événement, des bibliothèques, musées, archives et autres entités culturelles à travers le globe proposent des images issues de leurs fonds, à coloriser.

08/02/2024, 13:05

Babelio enrichit Babelthèque, son service à destination des bibliothèques

En 2009, Babelio lançait Babelthèque, un service de découverte de livres et d'enrichissements numériques à destination des bibliothèques publiques. L'objectif était d'aider les lecteurs et le personnel des établissements à choisir leur future lecture parmi des collections souvent vastes, mais dépourvues d'outils de recommandation informatisés.

05/02/2024, 17:16

La BnF confirme le vol de livres russes rares dans ses collections

La Bibliothèque nationale de France, comme d'autres établissements patrimoniaux européens, a été victime de plusieurs vols d'ouvrages rares et anciens d'auteurs russes. La BnF a porté plainte, tandis qu'une enquête pour vol commis en bande organisée est ouverte.

01/02/2024, 12:58

À Paris, “le seul quartier du XIXe sans bibliothèque municipale”

Zakaria Harroussi est le coauteur de Quartier de combat - Les enfants du 19e (Denoël 2021), avec le « grand frère » Abdoulaye Sissoko, et Pauline Guéna, l'autrice de 18.3 - Une année à la PJ (Denoël 2020). Avec l'ambition de venir dédicacer son ouvrage dans le quartier Danube de son enfance, Zakaria Harroussi en prend conscience : le territoire qui l'a vu grandir ne possède ni librairie, ni bibliothèque... La première absence a été résolue, la seconde non : face à cet état de fait, il a décidé d'alerter les pouvoirs publics par l'entremise d'une pétition.

25/01/2024, 17:04

À Montpellier, une résidence autour de l'information scientifique

Dans l'objectif de réaffirmer le rôle émancipateur de la culture scientifique et la nécessité démocratique de promouvoir une culture informationnelle de qualité, le Réseau des médiathèques et de la culture scientifique de Montpellier Méditerranée Métropole organise une résidence de diffusion axée sur l'éducation aux médias et à l'information scientifique.

25/01/2024, 15:44

Au Royaume-Uni, les bibliothèques en mal de reconnaissance

De l'autre côté de la Manche, les établissements de lecture publique ont besoin de reconnaissance, selon les conclusions d'un rapport commandé par le ministère de la Culture. Délaissés pendant de nombreuses années, sujets aux coupes budgétaires, ces services publics doivent être mis en avant et soutenus, notamment par une campagne d'information et de promotion.

22/01/2024, 13:38

À Toulon, les bibliothécaires seront encore et toujours dans l'action

Du 6 au 8 juin 2024, au Palais des congrès Neptune de Toulon (Var), les bibliothécaires français se retrouveront pour le congrès annuel de l'Association des bibliothécaires de France (ABF). Avec pour thème « La culture de l'action », ils débattront de l'action culturelle, une mission devenue centrale dans les établissements.

22/01/2024, 10:42

Métiers et formation en bibliothèque territoriale, troisième acte

Au sein du « Plan Bibliothèques » du gouvernement, un volet entier se consacrait à l'évolution des métiers et à la formation initiale et continue des professionnels. En 2021 était ainsi instituée un rendez-vous annuel, pour faire le point et poursuivre les réflexions. Les troisièmes Rencontres nationales annuelles des métiers et de la formation en bibliothèque territoriale auront donc lieu le 12 mars 2024.

16/01/2024, 10:05

Cyberattaque de la British Library : les auteurs, victimes collatérales ?

Frappée par une cyberattaque à la fin du mois d'octobre 2023, la British Library reste groggy, à l'heure où nous écrivons ces lignes. Outre les chercheurs et curieux, forcés de reporter leurs explorations des collections, surtout celles accessibles en ligne, l'incident pourrait faire d'autres victimes collatérales : les auteurs, qui attendent les recettes du droit de prêt...

10/01/2024, 16:03

À Strasbourg, une médiathèque squattée depuis des mois

Depuis plus de six mois, mai dernier précisément, la médiathèque du quartier de Neudorf, à Strasbourg, est confrontée à une situation délicate : des squatteurs occupent le premier étage du bâtiment. Ils y ont installé un campement de fortune, dans lequel on retrouve des matelas, canapés, couettes et même... une plante.

10/01/2024, 13:20

Détruite par une frappe russe, une bibliothèque reconstruite en pain d'épices

UkraineUnderAttack - Face aux bombes et à la haine, la créativité reste une alliée de choix. En 2015, alors que son mari se trouvait retenu dans une partie de l'Ukraine contrôlée par la Russie, Lena Zibert se lance dans la confection de gâteaux et pièces montées, pour combattre l'inquiétude. Des années plus tard, devenue une véritable experte, elle rend hommage à une bibliothèque iconique, abattue par les obus.

08/01/2024, 14:58

La BnF a atteint son record historique de fréquentation en 2023

En 2023, 1 450 000 personnes ont été accueillies sur l’ensemble des sites de la Bibliothèque nationale de France (salles de lecture, musée, expositions, manifestations). Le pic historique atteint en 2019, année ayant précédé la crise sanitaire qui avait enregistré plus de 1 300 000 personnes accueillies, est ainsi dépassé en 2023.

04/01/2024, 16:32

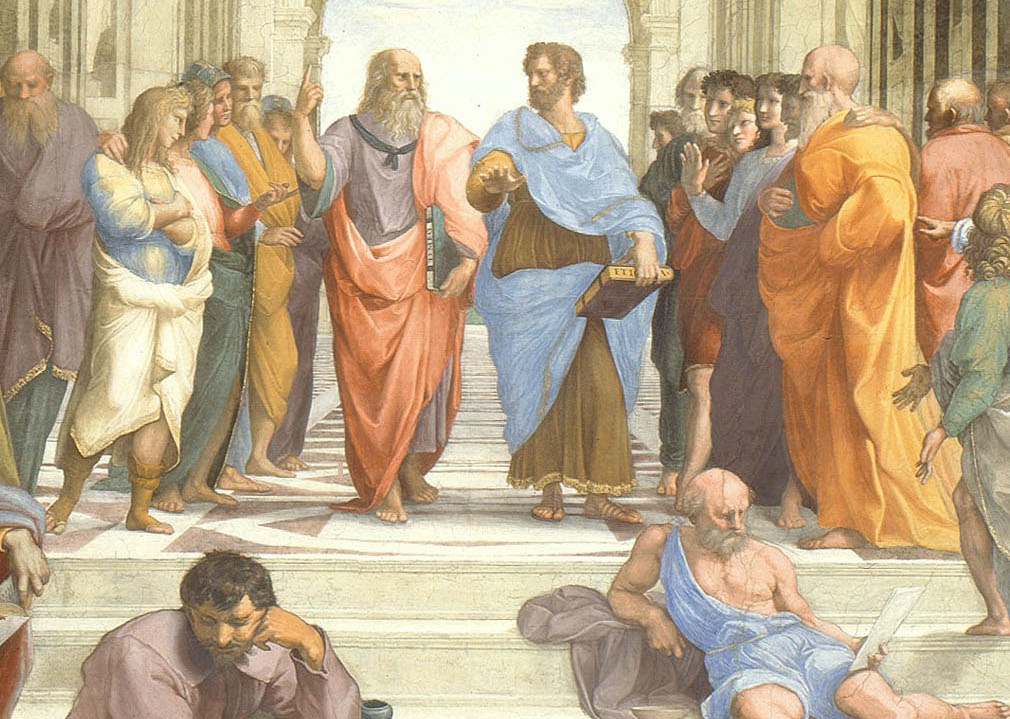

La vie des bibliothèques au pays de Platon

L'Autorité statistique hellénique a publié les résultats de son enquête sur les bibliothèques grecques pour 2022. Par rapport à 2020, année marquée par la crise sanitaire, l'affluence de lecteurs dans les 347 bibliothèques de Grèce en 2022 a connu une hausse, bien qu'elle reste inférieure aux chiffres de 2018. Depuis 1970, cette étude bisannuelle est réalisée par l'Office National de Statistique de Grèce (ELSTAT).

29/12/2023, 17:19

L'Inguimbertine, bibliothèque-musée sous le soleil de Provence

La réouverture de l'Inguimbertine, bibliothèque-musée unique en son genre en France, se fera dans un espace flambant neuf de 10.000 m2 situé à l'Hôtel-Dieu de Carpentras. Cette grande inauguration, qui se déroulera du 19 au 21 avril 2024, marquera l'achèvement d'un projet de rénovation de 15 ans autour du deuxième plus imposant monument historique du Vaucluse.

20/12/2023, 11:48

Rhysida, l'équipage pirate qui a sabordé la British Library

Fin octobre, la British Library émettait de premiers signaux de détresse, évoquant un système informatique en rade. Depuis le 8 novembre, l'établissement désigne officiellement l'incident comme une cyberattaque et rétablit, petit à petit, les différents services mis à mal. Entre-temps, des données personnelles d'usagers ont fait leur apparition sur le dark web.

19/12/2023, 12:24

Le Pass BnF lecture/culture désormais accessible dès 14 ans

Ce 15 décembre, la Bibliothèque nationale de France (BnF) a annoncé une initiative significative : le Pass BnF lecture/culture, désormais accessible dès 14 ans. Ce programme sera lancé le 19 décembre 2023, permettant aux jeunes dès cet âge d'accéder aux salles de lecture du site François-Mitterrand. Pour les 14-16 ans, ce Pass est gratuit durant la première année.

15/12/2023, 16:55

Bookinou et le CNL s'associent pour les Nuits de la lecture

Pour les Nuits de la Lecture 2024, prévues du 18 au 21 janvier, Bookinou collabore avec le Centre national du Livre (CNL) pour enrichir les bibliothèques avec des ateliers de lecture autonome, centrés cette année sur le thème du corps.

15/12/2023, 14:28

Face à une “crise de la censure”, la liberté de lire à la dure

BookBanUSA — Depuis plusieurs années désormais, les États-Unis sont traversés par un courant réactionnaire qui en veut particulièrement aux livres évoquant les personnes LGBT+ ou la lutte contre le racisme. Une proposition de loi, au Congrès, cherche à soutenir les districts scolaires visés par ce mouvement de censure.

14/12/2023, 11:07

Belgique : il pleut dans la bibliothèque de Mouscron

« Il pleut chez nous, la bibliothèque sera fermée temporairement... gros dégâts des eaux », partage la bibliothèque publique de Mouscron, située dans la province de Hainaut. En conséquence, il est impossible pour l'institution de recevoir des usagers « ces prochains jours », et au minimum toute cette semaine.

12/12/2023, 11:48

Autres articles de la rubrique Métiers

If I Must Die : un recueil posthume du poète palestinien Refaat Alareer

La maison d’édition indépendante et new-yorkaise OR Books annonce avoir acquis les droits pour la publication posthume du poète palestinien et professeur de littérature anglaise, Refaat Alareer. Mort lors d’un bombardement israélien le 6 décembre 2023, il léguait un poème terrible If I Must Die – devenu viral.

26/04/2024, 18:25

Olivia Arthur, lauréate du Fonds de soutien au livre photo jeunesse

Un tout nouveau fonds de soutien au livre photo jeunesse, mis en place par l’Institut pour la photographie, association et lieu de ressources et d'échanges situés à Lille, soutiendra la photographe documentaire Olivia Arthur. Cette dernière finalisera Lee and the Sea Things (Lee et les choses de la mer), un album réalisé avec des photo-collages.

26/04/2024, 15:12

Lié à des escalvagistes, le Prix Booker doit-il changer de nom ?

Le Booker Prize, ou Prix Booker en version française, reste l'une des récompenses littéraires les plus convoitées outre-Manche. Et même au-delà, avec le Booker Prize International, qui salue les œuvres d'auteurs du monde entier. Mais la légitimité de ces prix est mise en cause par son nom, hérité de deux frères esclavagistes.

26/04/2024, 11:42

2,5 millions € de butin en livres rares : un gang de voleurs démantelé

Ils avaient jeté leur dévolu sur des objets généralement ignorés par le grand banditisme : les livres rares et anciens. Quatre suspects ont été arrêtés en Géorgie dans le cadre d'une enquête européenne qui a mobilisé plus d'une centaine de policiers et procureurs. 27 sites ont été perquisitionnés, au total, en Géorgie et en Lettonie.

26/04/2024, 09:31

Italie : 60 éditeurs et 300 libraires indépendants unissent leurs forces

Indie Tree est un enthousiasmant projet de collaboration entre éditeurs et libraires indépendants italiens. Mis en place par les réseaux de promotion éditoriale Promedi et NW Consulenza e Marketing Editoriale, il implique 300 librairies indépendantes et plus de 60 éditeurs indépendants. L’objectif : développer des synergies entre les acteurs de l’indépendance éditoriale en Italie.

26/04/2024, 08:30

Le réalisateur d'Entre les murs, Laurent Cantet, est mort

Le monde du cinéma est en deuil après l'annonce du décès du réalisateur français Laurent Cantet, célèbre pour son film Entre les murs qui lui a valu la Palme d'Or au Festival de Cannes en 2008, adapté du roman homonyme de François Bégaudeau. Il nous a quittés à l'âge de 63 ans des suites d'une maladie, ce jeudi 25 avril à Paris, a confirmé son agent artistique, Isabelle de la Patellière. Il travaillait sur un nouveau projet cinématographique, L’apprenti, prévu pour une sortie en 2025.

25/04/2024, 18:08

“Une nouvelle démarche déloyale des éditions Oxymore” contre Delcourt

Les libraires en perdent leur latin : voilà plusieurs mois que la série Lulu et Nelson est annoncée par les très jeunes éditions Oxymore, fondées en février 2023 par Mourad Boudjellal. Le créateur de la maison Soleil, qu’il avait vendue au groupe Delcourt, en juin 2011, semble avoir du mal à se détacher de son ancienne société… qui publie justement Lulu et Nelson.

25/04/2024, 16:20

Frais de port du livre : un impact négatif pour 63 % des acheteurs

Depuis le mois d'octobre 2023, la commande d'un livre neuf sur internet suppose le paiement de frais de port d'un montant minimum de 3 €. Une mesure destinée à rétablir l'équité entre les libraires et les vendeurs en ligne, copieusement critiquée par le géant Amazon. Un sondage de l'IFOP, commandité par la multinationale américaine, assure qu'une partie des acheteurs de livres ont réduit leurs paniers.

25/04/2024, 16:19

Lagardère : baisse des ventes livre en France au 1er trimestre 2024

Au 31 mars 2024, Lagardère Publishing a noté une augmentation de son chiffre d'affaires à 576 millions d'euros (+0,8%), avec une croissance notable dans le numérique et l'audio. Toutefois, la branche française a subi un recul, principalement dans le secteur BD/manga. À l'international, des gains ont été réalisés au Royaume-Uni, aux États-Unis, et une stabilité en Espagne et Amérique latine.

25/04/2024, 13:15

Le philosophe américain Daniel Dennett est mort

Le philosophe américain Daniel Dennett est décédé à l'âge de 82 ans des suites d'une maladie pulmonaire, ce 19 avril. Il a largement contribué à la recherche fondamentale dans les sciences cognitives, notamment en explorant les implications de la théorie de l'évolution, ou en critiquant le dualisme cartésien, si imprégné dans le psychisme occidental.

24/04/2024, 18:28

L'Europe exclut le livre du règlement sur les retards de paiement

L'Europe a récemment exempté le secteur du livre d'un nouveau règlement sur les retards de paiement. Une décision saluée comme une victoire pour les libraires par le Syndicat de la librairie française (SLF) et la fédération européenne des libraires, l'EIBF, à laquelle il appartient, qui se sont vaillamment battus pour convaincre les différents acteurs impliqués.

24/04/2024, 18:18

Une bibliothèque allemande théâtre d'une attaque à la machette

Un homme de 31 ans, armé d'une machette, s'est introduit dans la bibliothèque universitaire de Mannheim ce mardi 23 avril, avant d'être abattu par la police vers 17h30, et de succomber de ses blessures à l'hôpital. Il se serait emporté contre une employée de la bibliothèque, et aurait menacé les policiers.

24/04/2024, 17:05

Editis : Laurine Mortha nouvelle directrice des fusions-acquisitions

Catherine Lucet, directrice générale d'Editis, et Dalila Zein, directrice générale déléguée, communiquent la nomination de Laurine Mortha au poste de directrice des fusions-acquisitions et des missions stratégiques.

24/04/2024, 16:11

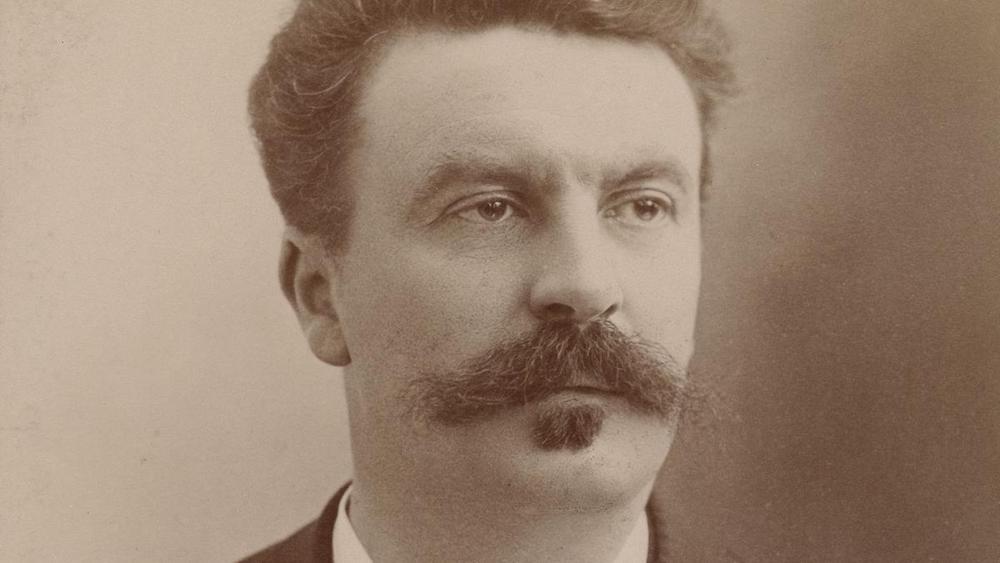

Maupassant, une vie, par la Grande Librairie

La série des « Docs de la Grande Librairie », créée par François Busnel, se poursuit le mercredi 15 mai avec un documentaire dédié à la vie et l'oeuvre de Guy de Maupassant. Réalisé par François Busnel et Adrien Soland, le film recevra divers intervenants tels que les écrivains Éric-Emmanuel Schmitt, Sylvain Tesson, Pierre Bayard et Olivier Frébourg, et les universitaires Noëlle Benhamou, et Martine Reid.

24/04/2024, 10:06

Dix ans après sa dernière enquête, Sherlock Holmes de retour

Sherlock Holmes est peut-être entré dans le domaine public, mais cela a rendu les ayants droit d'Arthur Conan Doyle plus regardants encore sur l'avenir du personnage. Il aura fallu dix ans pour relire une nouvelle enquête « officielle », validée par les héritiers. L'écrivain et journaliste britannique Gareth Rubin remettra face à face Holmes et son ennemi, Moriarty, en septembre prochain...

23/04/2024, 11:41

Détenteur de la licence Le Seigneur des Anneaux, Embracer se divise

Le groupe suédois Embracer a acté sa division en trois entités distinctes, afin de doter chacune d'entre elles d'une autonomie et d'une « stratégie propre ». Middle-earth Enterprises, filiale qui gérait les droits d'exploitation d'œuvres de Tolkien, devient une société de développement et d'édition de jeux vidéo, sous le nom Middle-earth Enterprises & Friends.

23/04/2024, 10:08

Le plaisir de la lecture commence dans les crèches

Fournir des livres aux établissements qui accueillent de très jeunes enfants, voici le dernier programme déployé en Italie. Ce projet cible tout particulièrement les territoires les plus fragiles du Bel Paese. Après une première édition, l’Association des éditeurs réitère son initiative. Pour assurer et développer un lien, dès le plus jeune âge, avec la lecture.

23/04/2024, 10:04

Tétraplégique, l'auteur Hanif Kureishi “écrit bien plus qu'avant”

Peu après Noël 2022, la vie du romancier et dramaturge Hanif Kureishi a été bouleversée : alors qu'il se promène à Rome, il s'évanouit et, après une mauvaise chute, se retrouve incapable de bouger. Transporté à l'hôpital, il y restera près d'un an, subissant notamment une opération de la colonne vertébrale. Devenu tétraplégique, il poursuit son œuvre, envers et contre tout.

23/04/2024, 09:29

Bruxelles, une menace pour la vie privée des dirigeants de Vivendi

La fusion de Lagardère avec Vivendi poursuit son bonhomme de chemin… devant la justice européenne. Ce 11 avril, la Cour de Justice de l’Union européenne a donné raison au groupe des Bolloré. En cause, une ordonnance que la société contestait en ce qu’elle exigeait la collecte et la conservation de documents potentiellement sensibles, impliquant des données personnelles.

22/04/2024, 18:47

En Italie, Meloni et la Rai ont-ils menti pour mieux censurer ?

Le lauréat du prix Strega 2019, Antonio Scurati, avait prévu de présenter un monologue sur l'antifascisme à la télévision publique italienne, la Rai, pour coïncider avec la fête de la Libération le 25 avril. Une intervention finalement annulée, entraînant des soupçons de censure, notamment à cause des critiques que l'écrivain voulait explicitement porter envers la Première ministre Giorgia Meloni. La chaîne a nié toute censure, arguant que l'annulation était due à des raisons financières... Une note a fuité, qui prouve qu'elle a menti... La polémique enfle.

22/04/2024, 14:49

Livre d'occasion : le Conseil permanent des écrivains souhaite une “concertation”

Le Conseil permanent des écrivains (CPE) a exprimé ses préoccupations suite à la publication d'une étude réalisée par Sofia et le Ministère de la Culture, datée du 10 avril 2024. Cette étude met notamment en lumière une augmentation significative des ventes de livres d'occasion, qui représentaient 20 % du marché en 2022.

22/04/2024, 13:32

L'acteur Chris Pine signe son premier livre jeunesse

L'acteur et réalisateur américain Chris Pine, connu pour ses rôles dans Star Trek Into Darkness (2013), Wonder Woman (2017) ou plus récemment Donjons et Dragons : L'Honneur des voleurs (2023), publiera cette année son premier ouvrage pour la jeunesse. L'histoire d'une bataille entre deux animaux, un chien et un écureuil, pour défendre leur territoire...

22/04/2024, 12:24

Japon : une amende de 10 millions € pour un pirate de mangas

Mangamura. À la fin des années 2010, ce nom faisait trembler de rage les plus grands éditeurs japonais de mangas, dont Kadokawa, Shueisha et Shogakukan. En 2017, ils avaient uni leurs forces pour abattre la plateforme pirate aux quelque 100 millions de visiteurs mensuels, avant de se tourner vers les opérateurs... La justice a condamné l'un d'entre eux a une amende de 10 millions €.

22/04/2024, 10:58

Un écrivain italien interdit de télé : le spectre de Meloni plane

La relation entre intellectuels et pouvoir a toujours été un sujet de débat, tout comme le lien entre politique et littérature. Mais, depuis l’arrivée de Giorgia Meloni en octobre 2022, le débat s’est enflammé en Italie. Preuve, suite à la décision d’annuler le monologue d’Antonio Scurati prévu sur la télévision publique italienne, la Rai, au sujet de l’antifascisme.

20/04/2024, 18:56

Mort de Georges Forestier, spécialiste de Molière, Corneille et Racine

Georges Forestier, né le 13 juin 1951 à Nice et décédé le 18 avril 2024 d'un cancer annonce Sorbonne Université, était un éminent professeur de littérature française et un historien du théâtre reconnu, particulièrement spécialisé dans le théâtre du XVIIe siècle. Il a enseigné à l'Université Paris-Sorbonne de 1995 à 2020, avant de devenir professeur émérite à Sorbonne Université.

19/04/2024, 20:35

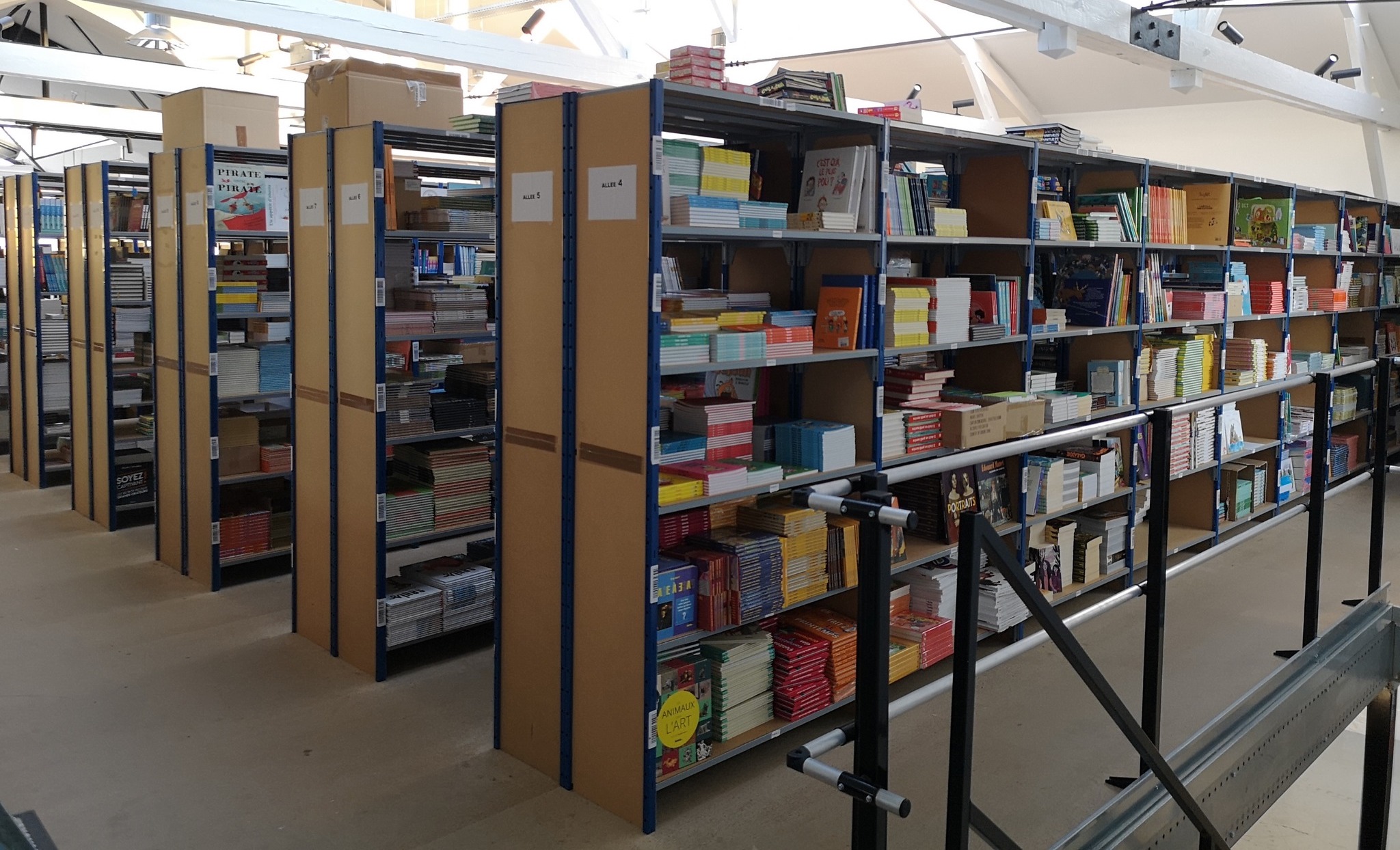

Des livres neufs à prix réduit : une solution pour les collectivités

Depuis cinquante ans, Expodif fournit collectivités et revendeurs : quelque 5000 références dans son catalogue, issues de lots rachetés auprès d’une centaine de fournisseurs. Et des livres neufs revendus à des prix concurrentiels – entre 40 et 65 % du prix éditeur.

19/04/2024, 17:32

L'Autrichien qui avait fait plier Facebook s'attaque à Meta

Voilà dix ans, cet activiste originaire de Salzbourg publiait un ouvrage mettant farouchement en cause le fonctionnement du réseau social Facebook : Kämpf um deine Daten (Luttez pour vos données), dénonçait le moissonnage d’informations que pratique la société de Mark Zukerberg. Mais Max Schrems n’en a résolument pas fini avec Meta…

19/04/2024, 15:45

Chine, Occident et Liu Cixin : un Problème à trois corps

Le roman culte de Liu Cixin a très récemment été adapté en série par Netflix. Le géant américain n'a pas hésité à sortir les grands moyens pour faire de cette histoire la nouvelle grande saga de la pop culture du XXIe siècle. Le succès attendu est au rendez-vous pour la plateforme de streaming, mais la série reflette-t-elle vraiment toute la complexité que recouvre « le problème à trois corps » ?

19/04/2024, 11:14

À Manhattan, une douce France dans la librairie de Cyril Dewavrin

Cyril Dewavrin a de la suite dans les idées : propriétaire de l'enseigne La Comédie Humaine à Avignon, inaugurée en 2018, c'est au cours d'un voyage aux États-Unis qu'il décide de tenter l'aventure outre-Atlantique. Depuis début décembre 2023, La Joie de Vivre propose, dans le quartier de Chelsea, à Manhattan, un petit coin de France aux New-Yorkais.

19/04/2024, 10:53

Reconnue coupable de faute, l'Agessa condamnée à indemniser un auteur

30.000 €, pas moins. Voilà le montant des dommages et intérêts que le tribunal judiciaire de Paris a sommé à feue l’Agessa d’indemniser, pour avoir porté préjudice à un artiste auteur. Un montant qui donnera le hoquet aux pouvoirs publics : de fait, quelque 200.000 personnes seraient concernées par les 40 années d’incurie de l’organisme. Rapide calcul : faudrait-il trouver 6 milliards € ?

18/04/2024, 18:50

Erri De Luca, Lola Lafon ou Javier Cercas rêvent l'Europe dans une revue

À l'approche des élections européennes, en juin 2024, la revue Zadig et la chaine franco-allemande Arte s'associent autour d'une publication exceptionnelle, sous le mot d'ordre « Rêver l'Europe ». Dans ses pages, plusieurs plumes se croisent, dont Erri De Luca, Lola Lafon, Javier Cercas ou encore François-Henri Désérable.

18/04/2024, 14:52

Académie des beaux-arts : Thierry Groensteen élu correspondant

La bande dessinée renforce encore sa place au sein de la prestigieuse Académie des beaux-arts, abritée par l'Institut de France, à Paris. Ce 17 avril a en effet été élu Thierry Groensteen, historien et théoricien du 9e art, en tant que correspondant de la section de gravure et dessin.

18/04/2024, 12:52

Promotion de la transphobie : mode d'emploi d'une Transmania

Suite aux pressions exercées par des activistes et quelques élus municipaux de Paris et de Lyon, JCDecaux a annoncé procéder au retrait des affiches publicitaires de l'ouvrage Transmania, jugé « transphobe et complotiste ». Un retrait qui a fait plus parler de lui que l'ouvrage en lui-même... Il n'y a pas de mauvaise publicité : tout est bon à prendre...

18/04/2024, 12:33

Budget 2024-2025 du Canada : où sont passés les engagements ?

Personne ne digère vraiment la présentation du budget 2024-2025 par la ministre des Finances, Chrystia Freeland. Les organisations professionnelles du monde de la culture attendaient fermement que s’y retrouve la Loi sur le droit d’auteur. Espoir déçu et mauvaise nouvelle en perspective.

18/04/2024, 11:44

L'enfer pour le “paradis du manga” : quel avenir pour piccoma France ?

Malgré des résultats au Japon sidérants en 2023, le propriétaire sud-coréen de la plateforme piccoma, Kakao Entertainment Corp. enclenche une restructuration. Les nouveaux dirigeants se sont engagés auprès des actionnaires à rechercher une croissance organique désormais.

18/04/2024, 11:20

1 Commentaire

DOUBITA

27/09/2019 à 18:32

Mon "bulletin de sortie" du CHU de Besançon indique en plus de mon n° d'affiliation (qui est juste) l'indication suivante "99 SDF / ETRANGER"

Ma carte d'électeur remise cette année 2019 porte comme département de naissance : "93 SEINE SAINT DENIS DEPARTEMENt DZE CONSTANTINE"

Ma question : suis-je victime des "algorithmes" ?- A qui me plaindre ?

et comment réclamer un préjudice ?

Merci de bien vouloir me répondre