Un tiers des demandes de retraits de contenu à Google serait invalide

Une nouvelle étude publiée par des chercheurs de l’Université de Columbia, située à Berkeley, révèle que plus de 28 % des takedown — demandes de retrait de contenus ou désactivation d’URL — reçues par Google sont « douteuses », voire invalides. Près de 5 % des avis de retrait qui ont été examinés ne ciblent pas le contenu supposé porter atteinte aux porteurs de droits d’auteur, tandis que 24 % des avis soulèvent d’autres préoccupations, y compris l’utilisation équitable des données sur internet.

Le 13/04/2016 à 09:25 par Orianne Vialo

0 Réactions | 0 Partages

Publié le :

13/04/2016 à 09:25

0

Commentaires

0

Partages

(Cesar Solorzano / CC BY-NC-ND 2.0)

Ces dernières années, le nombre de demandes de « DMCA takedown » (le fait de demander la désactivation d’une adresse web) adressées à Google a considérablement augmenté. À l’origine de ces réclamations : les détenteurs de droits d’auteur qui exigent qu’un contenu soit supprimé d’un site internet, car il a été publié sans leur accord — il peut s’agir de textes, photos, de vidéos, ou de photos couverts par le droit d'auteur.

En 2008, le moteur de recherche recevait seulement quelques douzaines de demandes de takedown par an, mais aujourd’hui, il en traite en moyenne près de deux millions par jour. Mais pour quelle raison les chiffres ne cessent de gonfler ? Tout simplement parce que les détenteurs de droits d’auteur ont pris conscience de la gravité de la situation et exigent massivement des actions antipiratage plus strictes, fonctionnalités le plus souvent mises en place par les moteurs de recherche et autres intermédiaires.

Les propriétaires de ces données volées n’hésitent plus à qualifier le système actuel de « système défaillant » puisque certaines demandes de retrait concernent des URL de sites web qui ont été fermés il y a plus d’un an, à l’image des sites Megaupload.com et BTJunkie.org.

Pour sa part, Google craint que l’augmentation graduelle de ces demandes puisse conduire à une augmentation d’erreurs. En effet, plus les demandes se font en grand nombre, plus la marge d’erreur est élevée, et plus le géant américain risque de sanctionner à tord.

Cette semaine, les chercheurs de l’Université de Columbia ont publié un rapport détaillé du régime de retrait en cours, qui permet d’analyser plus précisément les millions de demandes de retrait que Google reçoit chaque semaine.

Cependant, il convient de souligner que les recherches réalisées par les chercheurs de l’Assemblée américaine de l’Université de Columbia ont en partie été financées par Google, comme une volonté du géant d’améliorer la qualité des services qu’il propose.

Google a fourni ses données pour analyse à Lumen — un projet de recherche indépendant tiers créé pour analyser les demandes DMCA et autres plaintes formulées à l’encontre du contenu en ligne —, et les chercheurs ont examiné avec exactitude plus de 108 millions de demandes de retrait. La grande majorité de ces dernières étaient issues à 99,8 % de recherches web ciblées.

Ils ont découvert que plus de 28 % des demandes formulées étaient invalides, car elles incriminaient du contenu qui n’était pas forcément détectable, ou alors déjà effacé. Cela inclut également le fait que dans 4,2 % des cas, l’intitulé des données volées ne figure pas directement dans l’URL signalée. Google supprimerait donc ainsi plus de contenus qu’il ne le devrait.

« Près d’un tiers des demandes de retrait (28,4 %) présentaient des caractéristiques qui ont soulevé de véritables questions sur leur validité, fondées uniquement sur l’examen et les comparaisons que nous avons pu mener », écrivent les chercheurs dans leur étude.

Et de poursuivre : « Les contenus considérés comme frauduleux par les robots des moteurs de recherches ne le sont pas toujours. Ce qui pousse à se demander à quel point leurs algorithmes automatisés peuvent être précis. La principale raison de notre étude est de pousser à revenir à un mode de fonctionnement antérieur, qui consiste à rendre les jugements de ces contenus ciblés plus humains ».

Dans une interview accordée à TorrentFreak, Joe Karaganis, coauteur du rapport et vice-président de l’Assemblée américaine de l’Université de Columbia, déclarait « les reports des robots sont parfois problématiques, car l’augmentation de leur volume rend l’examen humain quasi impraticable. »

Des améliorations en vue ?

Actuellement, la société Google répond favorablement à 97,5 % des demandes de retrait, ce qui signifie que la grande majorité des demandes pourtant considérées comme douteuses sont honorées.

« Étant donné le risque élevé de sanctions légales appliquées dans le cas où un service rejetterait une demande dite valable, la plupart sinon la totalité des demandes reçues sont acceptées », détaillent les chercheurs.

Ces derniers recommandent à Google de changer son algorithme de détection de contenus frauduleux, mais surtout de repenser la façon dont le processus de retrait actuel pourrait être amélioré.

Google pourra bientôt mettre les résultats de cette étude à exécution puisque le gouvernement américain a récemment lancé une consultation publique pour évaluer l’efficacité de la sphère de sécurité des DMCA. Les problématiques abordées incluent les questions tournant autour des demandes de retrait automatiques mais aussi les abus potentiels.

(via TorrentFreak)

Plus d'articles sur le même thème

À Manhattan, une douce France dans la librairie de Cyril Dewavrin

Cyril Dewavrin a de la suite dans les idées : propriétaire de l'enseigne La Comédie Humaine à Avignon, inaugurée en 2018, c'est au cours d'un voyage aux États-Unis qu'il décide de tenter l'aventure outre-Atlantique. Depuis début décembre 2023, La Joie de Vivre propose, dans le quartier de Chelsea, à Manhattan, un petit coin de France aux New-Yorkais.

19/04/2024, 10:53

Budget 2024-2025 du Canada : où sont passés les engagements ?

Personne ne digère vraiment la présentation du budget 2024-2025 par la ministre des Finances, Chrystia Freeland. Les organisations professionnelles du monde de la culture attendaient fermement que s’y retrouve la Loi sur le droit d’auteur. Espoir déçu et mauvaise nouvelle en perspective.

18/04/2024, 11:44

À Hong Kong, la loi sur la “sécurité” met le livre en danger

À Hong Kong, l'emprise de la Chine est désormais une réalité quotidienne. Depuis la rétrocession du territoire au géant voisin par le Royaume-Uni, le régime communiste s'impose, petit à petit. Ses lois sur « la sécurité nationale » se succèdent, avec des conséquences importantes pour les libertés individuelles. Y compris dans le monde du livre, qui s'en inquiète.

17/04/2024, 12:17

Dans l'Iowa, une censure combattue par les “Big Five” de l'édition

BookBanUSA — De l'autre côté de l'Atlantique, de nombreux États se sont dotés de législations très contestées, qui facilitent le signalement et le retrait d'ouvrages des collections des bibliothèques publiques ou scolaires. Dans l'Iowa, une action en justice s'oppose à ces lois de censure, avec le soutien des plus grands groupes éditoriaux américains...

17/04/2024, 10:41

Pham Doan Trang, autrice et éditrice en prison, honorée par un prix

L'autrice et éditrice vietnamienne Pham Doan Trang, qui purge actuellement neuf années de prison au sein d'un établissement de la province de Bình Dương, a été désignée lauréate du Barbey Freedom to Write Award. Cette distinction salue l'engagement d'un « écrivain de conscience emprisonné ».

16/04/2024, 16:10

Robin Book : 12 ans de prison pour le plus grand voleur de livres

Ancien directeur de la bibliothèque Girolamini de Naples, Massimo Marino De Caro a obtenu d'entrer dans l'Histoire. Après un procès de la durée de 12 ans, il a été condamné par le tribunal de Naples à une nouvelle peine, pour un total de 12 ans de prison.

14/04/2024, 10:02

Internet : France et Québec réunis contre Chinois et Américains

La mission franco-québécoise initiée en 2019 avait débouché sur un appel à candidatures présenté trois ans plus tard. Au cœur de la collaboration entre la Belle Province et l’Hexagone, la découvrabilité des œuvres francophones. Ou comment exister dans un internet où d’un côté les GAFA américains, de l’autre les BATX asiatiques règnent en maîtres…

12/04/2024, 14:47

Un Webnovel à l'européenne : la révolution numérique de la lecture

Le webnovel poursuit sa conquête des lecteurs, avec un projet ouvert en Italie : nom de code, Narae. L’application verra le jour d’ici un an et réunit deux opérateurs : l’éditeur Mondadori et Bookrepublic, librairie fondée en 2010 et dédiée aux ouvrages numériques. Avec, pour directeur général, un certain Didier Borg, précurseur de la BD numérique en France...

08/04/2024, 18:31

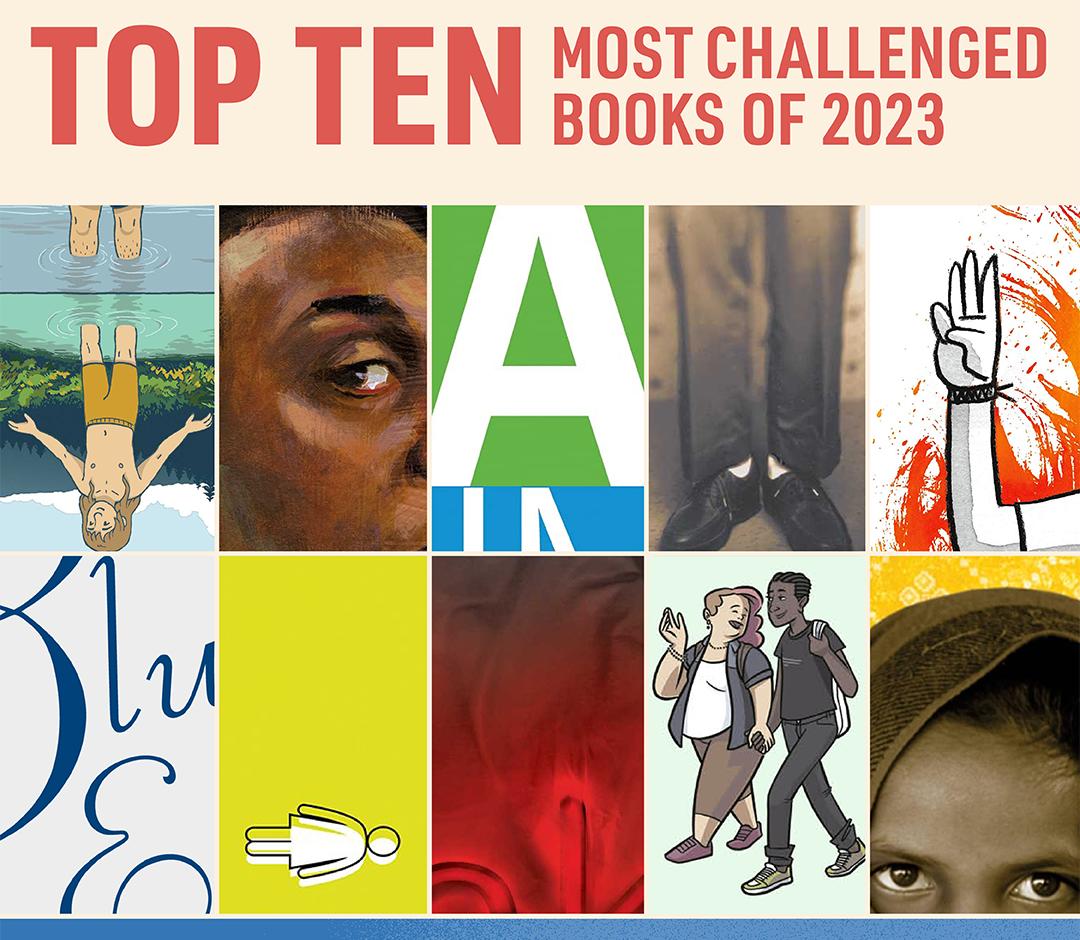

Censure : les dix livres les plus "contestés" en 2023, Toni Morrison dans le top 10

BookBanUSA - À l'occasion de la Semaine Nationale des Bibliothèques, initiée par l'American Library Association (ALA), cette dernière dévoile sa liste annuelle des « 10 Livres les Plus Contestés de 2023 ». Cette année, une augmentation de 65 % des tentatives de censure par rapport à 2022 a été enregistrée, un record selon l'ALA.

08/04/2024, 16:18

“Une société où tous les enfants auront un accès égal au livre”

Voilà quelques années que le 2 avril est consacré comme journée internationale du livre pour enfants – en référence à la date de naissance du Danois Hans Cristian Andersen. Avec le 23 avril, qui célèbre le droit d’auteur et le 25 qui marquera en France la fête de la librairie indépendante, le mois d'Apollon – conducteur des neuf muses – devient une période faste pour la lecture. Tout particulièrement en Grèce.

07/04/2024, 15:12

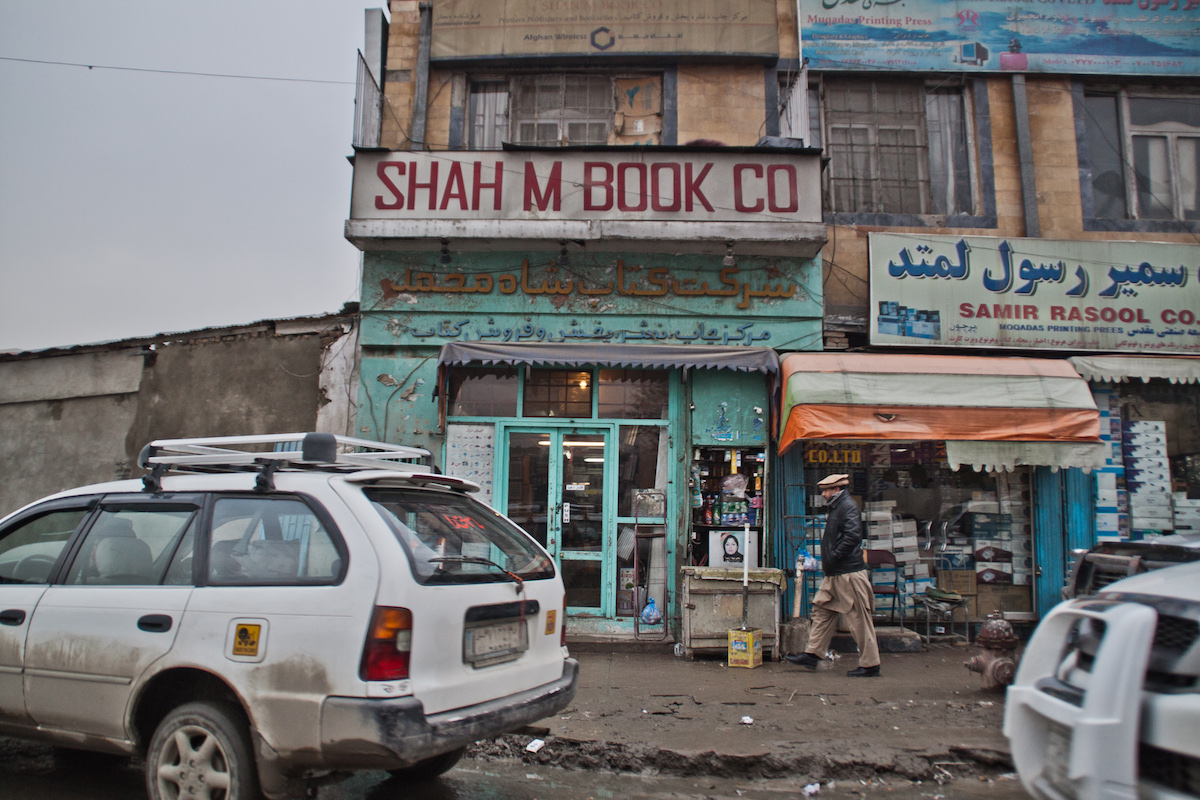

Malgré les talibans, ce libraire fournit des livres en Afghanistan

Le libraire Shah Muhammad Rais ne vous dit peut-être rien, mais vous pourriez bien l'avoir croisé dans un livre : la journaliste Åsne Seierstad avait raconté son quotidien dans Le Libraire de Kaboul (Le Livre de Poche, traduit par Céline Romand-Monnier). Aujourd'hui exilé au Royaume-Uni, il avait tout perdu avec le retour des talibans, en 2021, qui ont mis à sac son enseigne. Pourtant, il persiste et signe.

05/04/2024, 11:57

En Haïti, la Bibliothèque nationale prise pour cible par des gangs

En proie à une situation économique catastrophique, doublée d'une crise politique, Haïti est devenu le terrain d'une guerre des gangs dévastatrice. Les citoyens sont exposés à la violence, mais aussi les institutions et infrastructures de Port-au-Prince, la capitale. Dernière victime en date, la Bibliothèque nationale, qui a été pillée ce 3 avril.

04/04/2024, 11:01

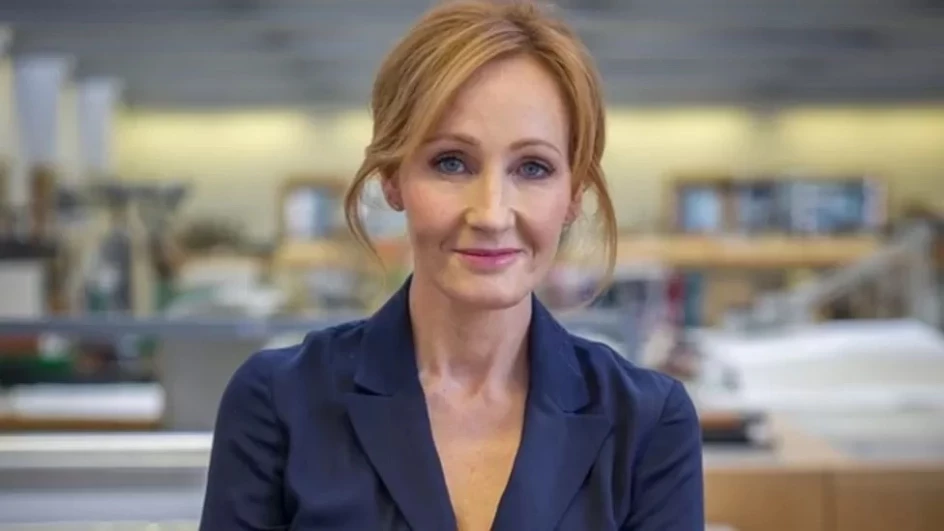

Bientôt en prison ? J.K. Rowling provoque les autorités écossaises

L'Écosse a introduit, ce 1er avril, un décret relatif à la nouvelle législation du pays contre l'incitation à la haine, qui n'a pas plu à celle qui vit à Edimbourg, J.K. Rowling... Il vise à consolider les mesures déjà en place en étendant spécifiquement la définition du délit d'incitation à la haine pour inclure les questions de transidentité. En réaction, l'autrice a publié sur X des cas de transgenres - tous s'identifiant comme femmes -condamnés pour des crimes sexuels...

02/04/2024, 16:53

Hong Kong : une librairie progressiste ferme sous la pression des autorités

Des centaines d'habitués, de lecteurs et de curieux se sont rassemblés ce week-end dernier devant la librairie indépendante Mount Zero, pour lui dire adieu. La boutique de deux étages était bondée d'amoureux de l'enseigne, qui avaient formé une communauté au cours des six dernières années. Elle ferme après une série de contrôles, suite à des plaintes anonymes...

02/04/2024, 16:42

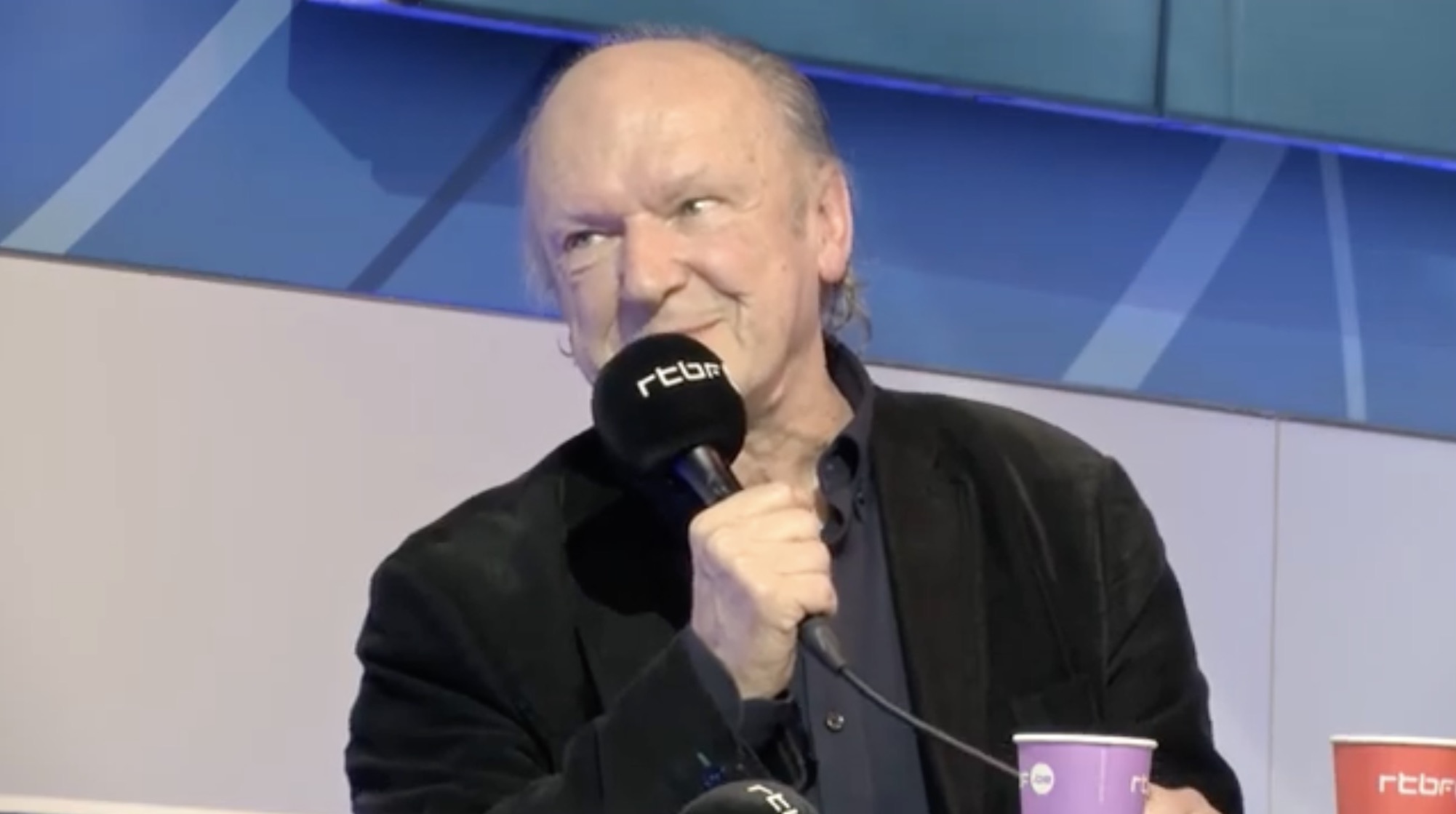

Mort du poète Guy Goffette, l'insatiable quête de beauté

Guy Goffette, né le 18 avril 1947 à Jamoigne dans la Gaume belge, aura été une figure emblématique de la poésie francophone contemporaine. Sa vie et son œuvre traversent les frontières géographiques et littéraires, reflétant un parcours riche et diversifié. Il est décédé le 28 mars 2024.

30/03/2024, 12:44

Les défis du présent, la condition des femmes : Vie imaginaire à Turin

Près de 2000 événements, plus de 800 stands, 137.000 m2 d’espace d’exposition : tels sont les chiffres de l’édition 2024 du Salon du livre de Turin, la première sous la direction de l’écrivaine et journaliste Annalena Benini. Lors de la dernière conférence de presse avant la manifestation, qui se tiendra du 9 au 13 mai, les nouveautés de cette année - dont le thème est La vie imaginaire – ont été dévoilées.

29/03/2024, 10:11

Multicondamné, Donald Trump se fait vendeur de Bibles

Milliardaire impliqué dans toutes sortes de secteurs, de l'immobilier aux compagnies aériennes, Donald Trump a récemment été rattrapé par la justice et contraint à payer de fortes amendes. Peut-être à la recherche de nouvelles sources de revenus, il s'est dernièrement associé à une société productrice de Bibles, vendues à distance.

27/03/2024, 12:18

La première agence littéraire internationale s'installe en Italie

La succursale basée à Milan sera le douzième bureau de l'agence fondée en 1977 par le légendaire Andrew Nurnberg. Certes. Mais surtout, le premier bureau ouvert au Bel Paese par une agence internationale. La direction sera confiée à Barbara Barbieri, qui travaille pour l’agence depuis douze ans.

23/03/2024, 12:05

Ramadan à Gaza : “Des dessins comme ça, on en fera d'autres”

La dessinatrice Coco, survivante de l'attaque de Charlie Hebdo, est actuellement au centre d'une controverse suite à la publication de son dessin intitulé Ramadan à Gaza dans le journal Libération, le 11 mars dernier. Ce dessin illustre un homme affamé poursuivant des rats parmi des ruines et un cadavre, tout en étant réprimandé par une femme pour le respect du jeûne du Ramadan. Menacée de mort ou dénoncée par des cadres de LFI entre autres, elle est également soutenue au nom de la liberté de caricaturer.

22/03/2024, 12:55

PEN International : “Les conflits ont un impact dévastateur sur l'écrit”

L'organisation non gouvernementale PEN International dénonce et lutte contre les menaces portées à l'encontre de la liberté d'expression des auteurs, dans le monde entier. Elle publie sa « Case List » pour l'année 2023, qui recense les attaques contre des écrivains ou des journalistes, dont elle a eu connaissance.

22/03/2024, 12:10

En Russie, Le Maître et Marguerite hérisse les pro-Poutine

Le Maître et Marguerite, roman de Mikhaïl Boulgakov rédigé entre 1927 et 1940, reste un exemple de littérature engagée contre le système soviétique mis en place par Staline. Mais le succès en Russie d'une nouvelle adaptation de l'œuvre, réalisée par Michael Lockshin, fait émerger une critique plus contemporaine : celle de la politique belliqueuse de Vladimir Poutine.

21/03/2024, 12:34

“Les éditeurs ont déjà réalisé les innovations d'Internet Archive”

ProcesIA - Reconnue coupable de violation du copyright en mars 2023, l'organisation non gouvernementale Internet Archive a fait appel du jugement. Elle revendiquait une mise à disposition des livres numériques conformes aux missions des bibliothèques, utile à l'intérêt général et en règle par rapport au fair use américain. Dans un mémoire, les éditeurs affirment qu'Internet Archive vient parasiter un marché déjà bien installé.

18/03/2024, 11:50

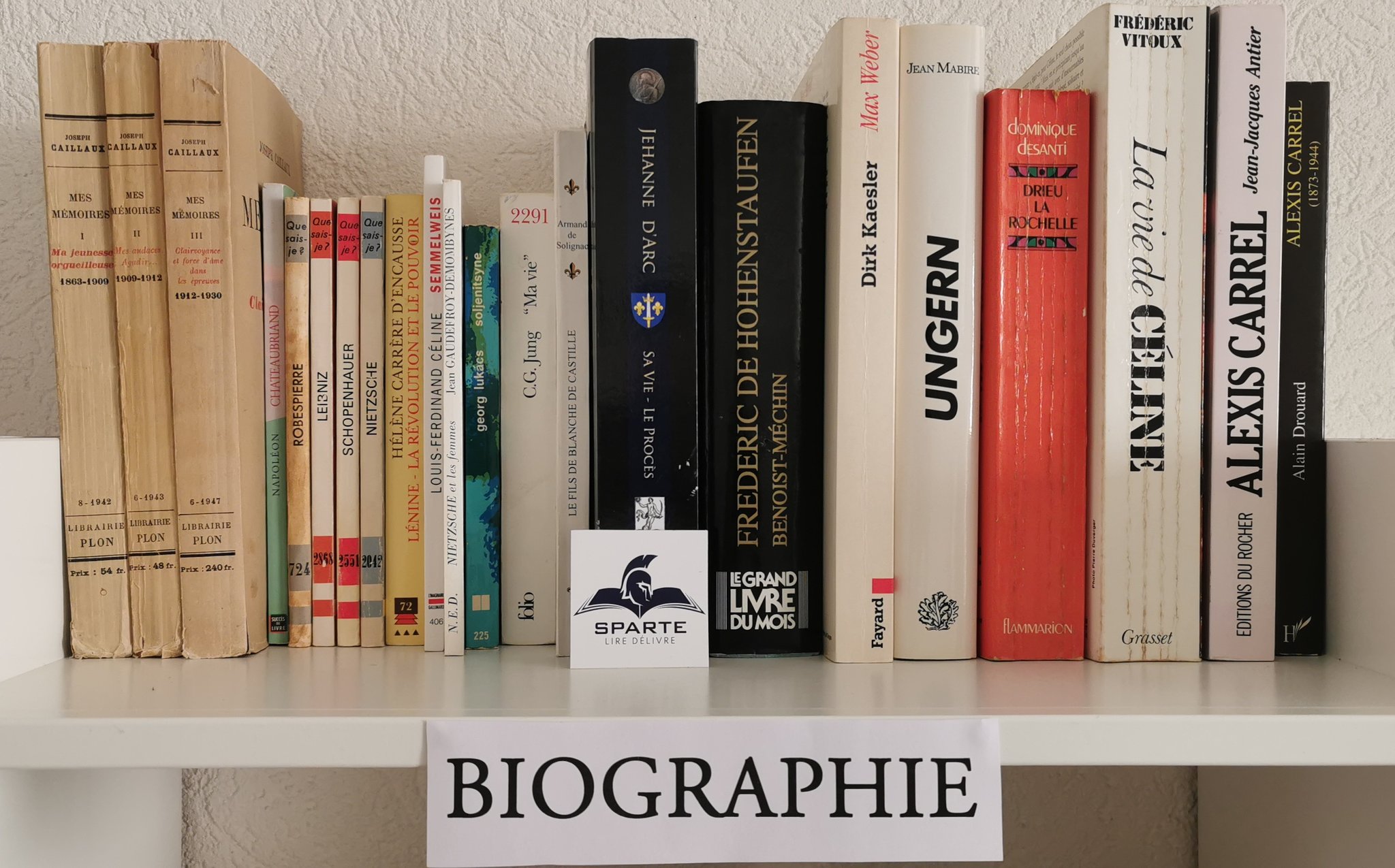

Genève : une librairie aux ouvrages douteux privée d'ouverture

Drieu La Rochelle, Brasillach, aux côtés d’Homere ou encore Alexis Carrel — ce chirurgien français devenu fervent admirateur du nazisme et adepte de l’eugénisme… la liste d’ouvrages que proposait la librairie Sparte laisse en bouche un goût bien écœurant. Et pour cause, derrière cet établissement, se tapit le mouvement identitaire Résistance helvétique « dont l’objectif est la survie de la Suisse ».

17/03/2024, 15:17

L'édition numérique en Afrique : un secteur en fort développement

Bbibliothèque numérique en streaming présente en Afrique avec plus de 1,3 million d’abonnés, YouScribe présente un Livre blanc compilant points de vue et retours d’expériences d'éditeurs africains face à un secteur de l'édition en mutation.

15/03/2024, 09:53

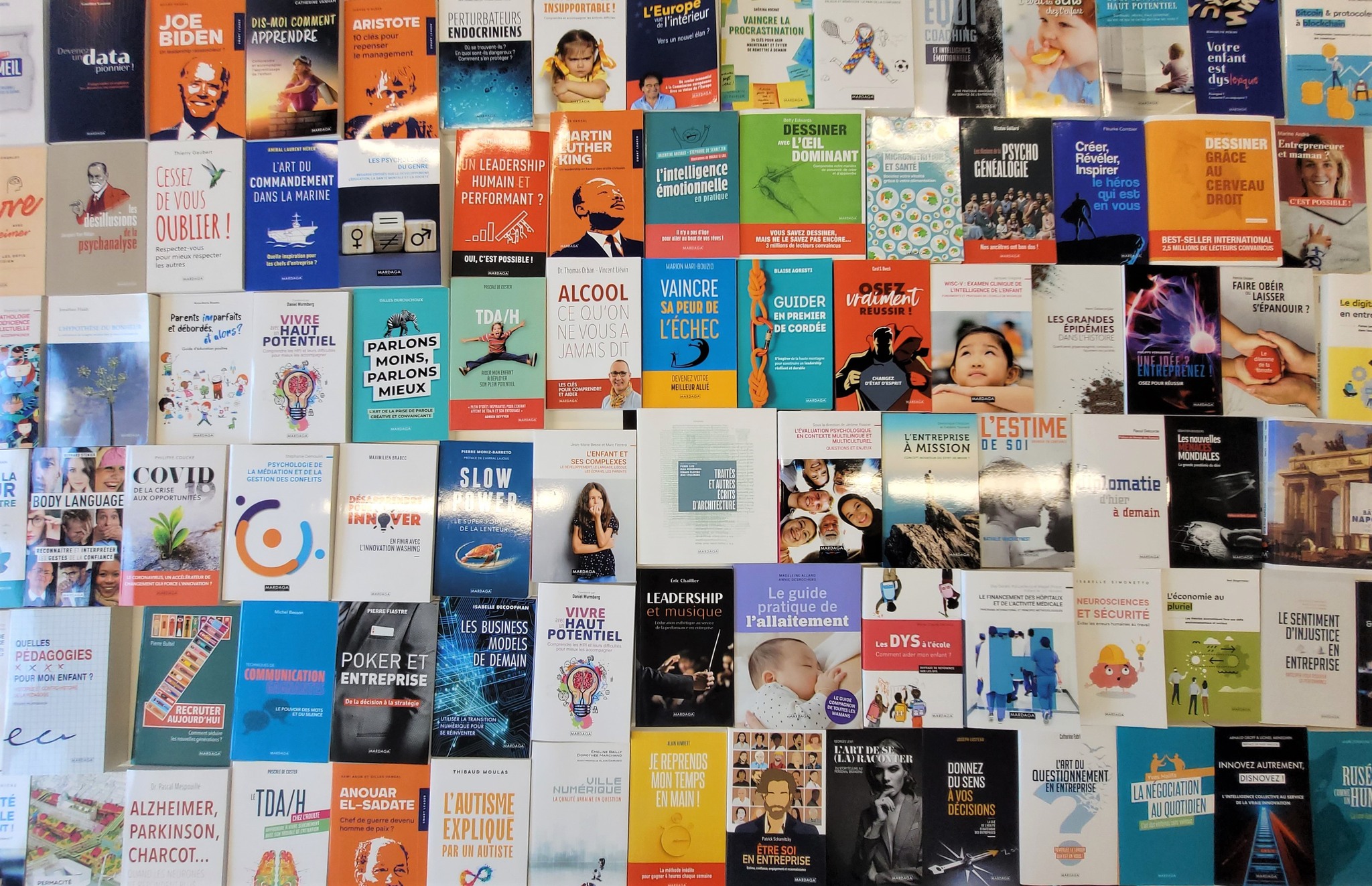

Le groupe Lemaitre rachète Ligaran et bascule chez Dilisco

Le groupe Lemaitre Publishing, qui compte déjà Mardaga et Renaissance du Livre, annonce aujourd'hui la reprise des éditions Ligaran. Fondée en 2009, cet éditeur français est spécialisé dans les classiques littéraires. Autre changement, la strucute prévoit de concentrer de ses futurs efforts de développements dans le numérique.

15/03/2024, 09:35

Explosion des tentatives de censure de livres en 2023 aux États-Unis

BookBanUSA - Le nombre de titres ciblés pour la censure a augmenté de 65 % en 2023 par rapport à 2022, atteignant le niveau le plus élevé jamais enregistré, avec 4240 titres uniques dans les écoles et bibliothèques, documente l'Association Américaine des Bibliothèques (ALA). Cette hausse dépasse le précédent record de 2022, où 2571 titres uniques avaient été visés.

14/03/2024, 17:07

Dans le monde, des marchés du livre à la merci des prix

GfK Entertainment et Nielsen BookData ont présenté leur premier rapport commun à vocation internationale, qui examine les marchés du livre de 16 pays, de l'Europe à l'Asie, en passant par l'Afrique, l'Asie ou l'Amérique. Si les chiffres d'affaires sont en hausse sur de nombreux territoires, l'inflation est aussi au rendez-vous.

14/03/2024, 12:11

Gutenberg Suisse : Dix ans avec le Salon du livre de Genève

Le jeudi 7 mars, un chapitre exceptionnel de la Confrérie de Gutenberg s’est tenu au Beau Rivage Genève sous la présidence de Martin Werfeli, ancien CEO de Ringier AG, pour célébrer le dixième anniversaire de « Gutenberg Suisse ».

14/03/2024, 09:23

En Floride, la censure homophobe des livres se lève un peu

BookBanUSA —Au fil de ses différentes lois restreignant la liberté de lire et la liberté pédagogique, la Floride s’est taillé une solide réputation d'État où la censure a le vent en poupe. Ces législations sont toutefois combattues devant la justice, et une fameuse victoire contre la loi « Don't Say Gay » vient d'être obtenue. Les livres évoquant des relations ou personnages LGBTQIA+ ne seront plus systématiquement mis à l'index.

12/03/2024, 13:25

Pearson accusé d'être trop partageur avec les données privées

Pearson, groupe éditorial britannique présent sur plusieurs continents, fait partie de ces incontournables dans le domaine éducatif. Aux États-Unis, dans l'État de New York, la multinationale est accusée d'avoir enfreint le Video Privacy Protection Act, en permettant à Meta, le propriétaire de Facebook, de collecter des données sans consentement.

12/03/2024, 10:26

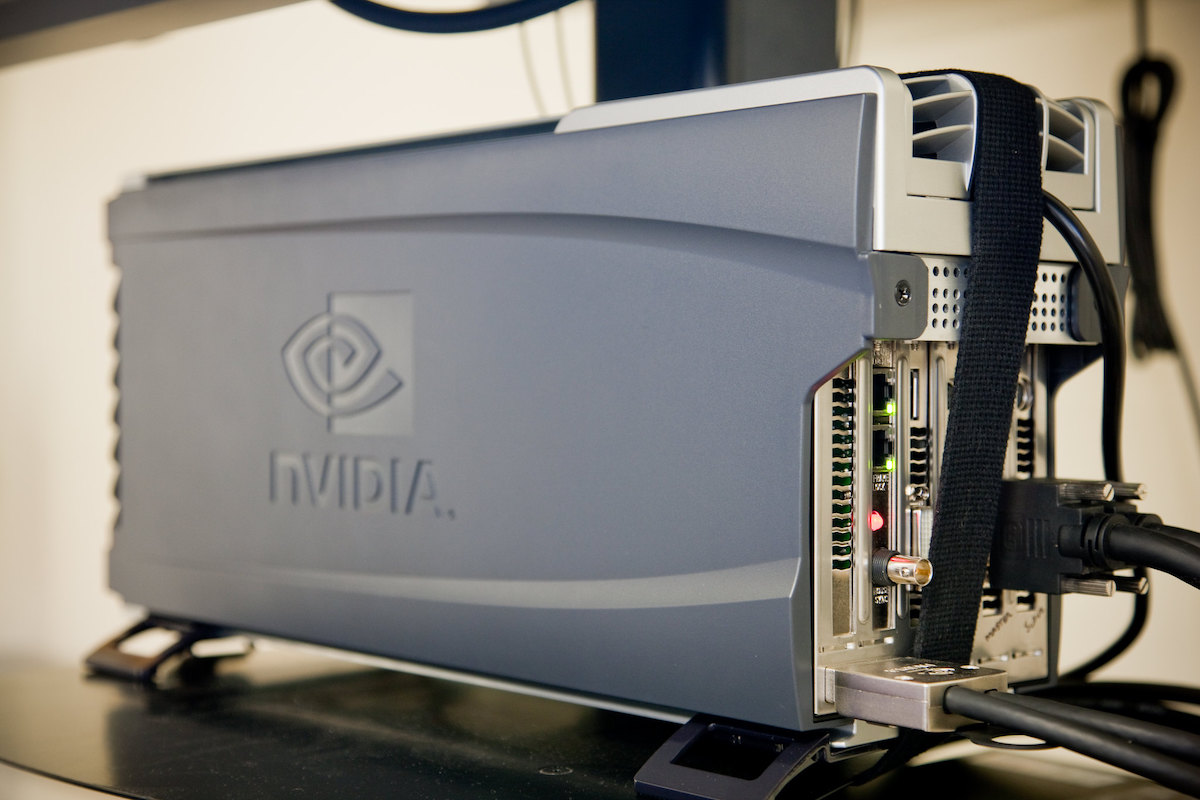

IA : la société Nvidia attaquée en justice par trois auteurs

Connue pour ses cartes graphiques, la société américaine Nvidia s'est, comme d'autres, investie dans le développement de technologies basées sur l'intelligence artificielle. À l'instar de Microsoft ou Meta, elle fait l'objet d'une plainte pour violation du copyright de trois auteurs, qui estiment que leurs œuvres ont été utilisées sans leur consentement dans le cadre de la création de NeMo, plateforme de conception et d'entrainement d'IA.

11/03/2024, 16:13

Pour sauver une culture entière, les Kurdes numérisent des textes

Rebin Pishtiwan, 23 ans, sillonne avec deux de ses collègues le territoire de la région autonome du Kurdistan, dans le nord de l'Irak, pour accomplir la mission que s'est fixée le Centre Kurde pour l'Art et la Culture (KCAC) : numériser un maximum de vieux ouvrages kurdes afin d'en sauver le contenu.

11/03/2024, 16:11

Manuscrit de “Hotel California” : les procureurs “manipulés”

Trois hommes, dont Glenn Horowitz, libraire américain spécialisé dans les pièces rares et uniques, faisaient face depuis plusieurs jours à la justice, accusés d'avoir dérobé des manuscrits et documents appartenant à Don Henley, chanteur, batteur, cofondateur et auteur-compositeur du groupe Eagles. Dont les paroles manuscrites de « Hotel California », fameux succès de la formation. Ce 6 mars, coup de théâtre : les procureurs ont abandonné les accusations, s'estimant « manipulés ».

07/03/2024, 09:58

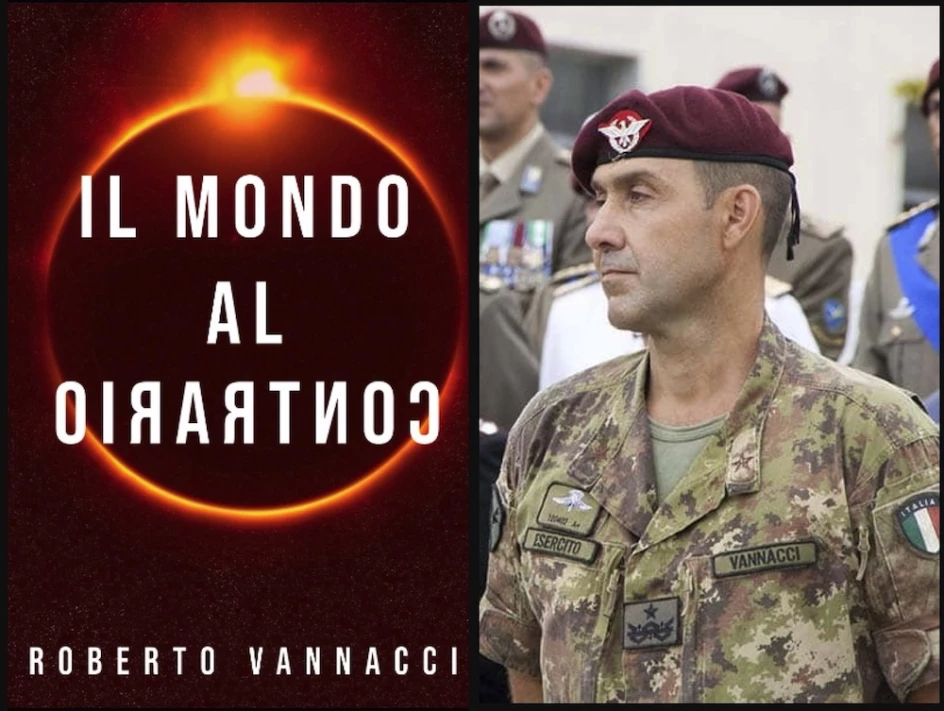

Le général italien auteur d'un livre raciste et homophobe rattrapé par la justice

En août dernier, Il mondo al contrario (Le monde à l’envers), un pamphlet critiquant les immigrés, les homosexuels et les minorités, devenait le best-seller sur Amazon Italia, avant de s'établir comme le livre le plus acheté dans le pays de Leopardi. Il envisage à présent même de se présenter aux élections européennes. C'était sans compter sur les ennuis judiciaires qui s'accumulent...

06/03/2024, 16:13

Au Québec, l'industrie du livre accuse le coup

Moins de livres vendus, malgré un chiffre d’affaires stable, voire en hausse, mais en apparence seulement : l’industrie du livre au Québec n’a pas échappé aux tendances déjà observées en 2023. La Banque de titres de langue française diffuse ce jour la 12e édition de son Bilan annuel Gaspard, découlant des données de 239 points de vente de la Belle Province. Un panorama du marché des plus instructifs…

05/03/2024, 16:00

Ebooks : Amazon devant la justice pour des prix trop élevés

Accusée de conspiration avec cinq grands groupes d'édition américains, afin de maintenir des prix élevés pour les livres numériques, la société Amazon reste au cœur d'une plainte qui dénonce désormais une situation de monopole. Les éditeurs, eux, sont écartés de la procédure.

05/03/2024, 12:35

Autres articles de la rubrique Métiers

Reconnue coupable de faute, l'Agessa condamnée à indémniser un auteur

30.000 €, pas moins. Voilà le montant des dommages et intérêts que le tribunal judiciaire de Paris a sommé à feue l’Agessa d’indemniser, pour avoir porté préjudice à un artiste auteur. Un montant qui donnera le hoquet aux pouvoirs publics : de fait, quelque 200.000 personnes seraient concernées par les 40 années d’incurie de l’organisme. Rapide calcul : faudrait-il trouver 6 milliards € ?

18/04/2024, 18:50

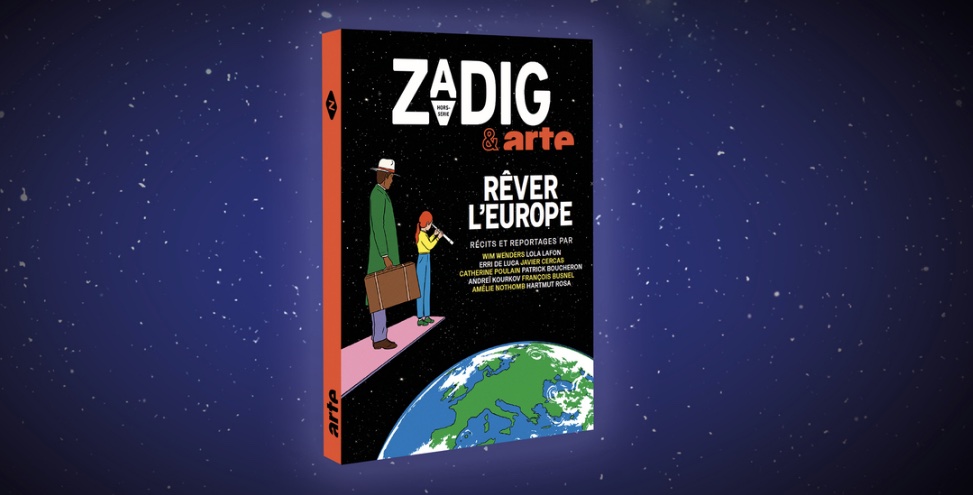

Erri De Luca, Lola Lafon ou Javier Cercas rêvent l'Europe dans une revue

À l'approche des élections européennes, en juin 2024, la revue Zadig et la chaine franco-allemande Arte s'associent autour d'une publication exceptionnelle, sous le mot d'ordre « Rêver l'Europe ». Dans ses pages, plusieurs plumes se croisent, dont Erri De Luca, Lola Lafon, Javier Cercas ou encore François-Henri Désérable.

18/04/2024, 14:52

Académie des beaux-arts : Thierry Groensteen élu correspondant

La bande dessinée renforce encore sa place au sein de la prestigieuse Académie des beaux-arts, abritée par l'Institut de France, à Paris. Ce 17 avril a en effet été élu Thierry Groensteen, historien et théoricien du 9e art, en tant que correspondant de la section de gravure et dessin.

18/04/2024, 12:52

Promotion de la transphobie : mode d'emploi d'une Transmania

Suite aux pressions exercées par des activistes et quelques élus municipaux de Paris et de Lyon, JCDecaux a annoncé procéder au retrait des affiches publicitaires de l'ouvrage Transmania, jugé « transphobe et complotiste ». Un retrait qui a fait plus parler de lui que l'ouvrage en lui-même... Il n'y a pas de mauvaise publicité : tout est bon à prendre...

18/04/2024, 12:33

L'enfer pour le “paradis du manga” : quel avenir pour piccoma France ?

Malgré des résultats au Japon sidérants en 2023, le propriétaire sud-coréen de la plateforme piccoma, Kakao Entertainment Corp. enclenche une restructuration. Les nouveaux dirigeants se sont engagés auprès des actionnaires à rechercher une croissance organique désormais.

18/04/2024, 11:20

IA et culture : Rachida Dati missionne le CSPLA

Devant la commission des affaires culturelles de l'Assemblée nationale, Rachida Dati avait annoncé qu'elle saisirait prochainement le Conseil supérieur de la propriété littéraire et artistique (CSPLA) sur plusieurs points liés à l'intelligence artificielle. Deux missions ont été officialisées, sur la transparence et l'effectivité des droits.

17/04/2024, 16:13

Des pubs télé pour le livre, une décision qui favorisera Vivendi ?

Après le SNE, c'est au tour du Conseil permanent des écrivains (CPE) - ADAGP, ATLF, Cose-Calcre, EAT, Maison de Poésie, Pen Club, Sacem, SAIF, SAJ, Scam, SELF, SGDL, SNAC, Union des Poètes, UPP -, et la Fédération des éditions indépendantes (FEDEI), d'affirmer leur opposition à la publicité pour le livre à la télévision, et le décret no 2024-313 du 5 avril 2024 qui la rend possible pendant une période d'au moins deux ans.

17/04/2024, 12:43

Consuelo et Antoine de Saint Exupéry, un couple de haut vol

Régulièrement séparé par les océans ou par les obligations aériennes de Saint-Exupéry, le couple n'en est pas moins resté amoureux et soudé pendant près de 15 ans, jusqu'à la mort de l'écrivain en 1944. Un documentaire inédit retraçant leur histoire sera diffusé le vendredi 10 mai à 23h10, sur France 5.

17/04/2024, 11:24

Le SNE contre la publicité télévisée pour les livres (sans régulation)

Le Syndicat national de l'édition (SNE) exprime de sérieuses préoccupations suite à la publication du décret du 5 avril dernier, autorisant la publicité pour les livres à la télévision pour une période de deux ans. Les éditeurs craignent que cette mesure ne fragilise le secteur de l'édition et n'appauvrisse la création littéraire, en l'absence de régulations spécifiques pour cette « expérimentation ».

17/04/2024, 10:52

Jean-Baptiste Passé nommé directeur général des éditions Michelin

En poste depuis la mi-septembre de 2021, l’ancien directeur général du Festival du livre de Paris quitte ses fonctions comme prévu. Selon les informations de ActuaLitté, il gagne le groupe Média Participations, où il prenda la tête de la coentreprise Michelin Éditions, qui édite guides gastronomiques, touristiques, cartes et plans.

16/04/2024, 18:46

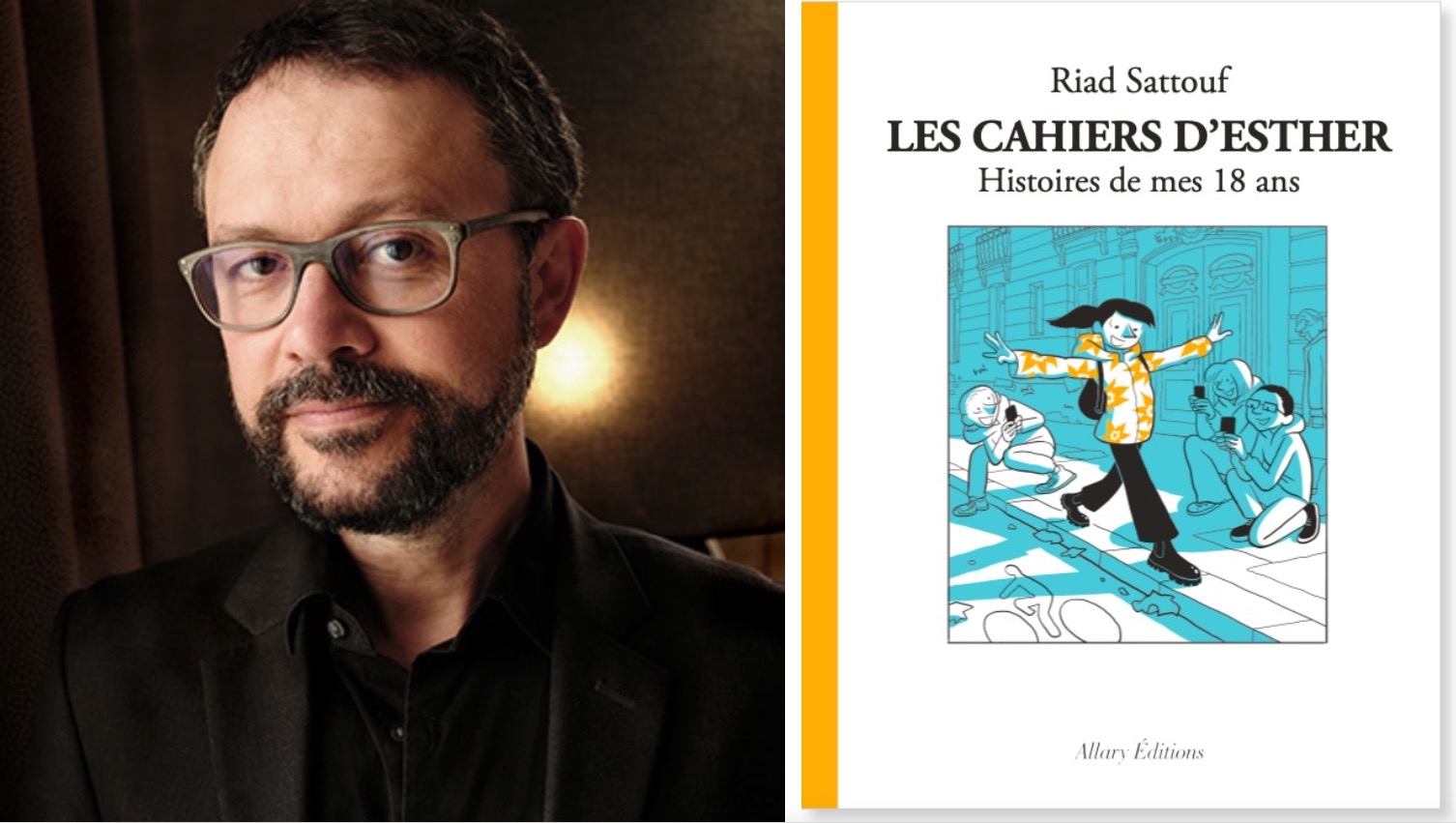

Les Cahiers d’Esther : en juin s'achève la saga de Riad Sattouf

Esther atteint sa majorité dans ce tome 9, Histoires de mes 18 ans, qui marque une étape cruciale dans sa vie... Alors qu'elle termine sa terminale, elle fait face au baccalauréat, aux choix d'orientation difficiles via Parcoursup, et à la fin imminente des Cahiers d'Esther...

16/04/2024, 18:11

Construire une offre de lecture pour les handicapés visuels, un temps long

Mi-mars, deux députés prenaient d’assaut le ministère de la Culture que Rachida Dati investissait tout juste. Et d’interpeller la rue de Valois quant à la politique d’aide à la lecture pour les personnes atteintes de handicaps. Plus spécifiquement, pour ce qui touche à l’édition en braille…

16/04/2024, 16:54

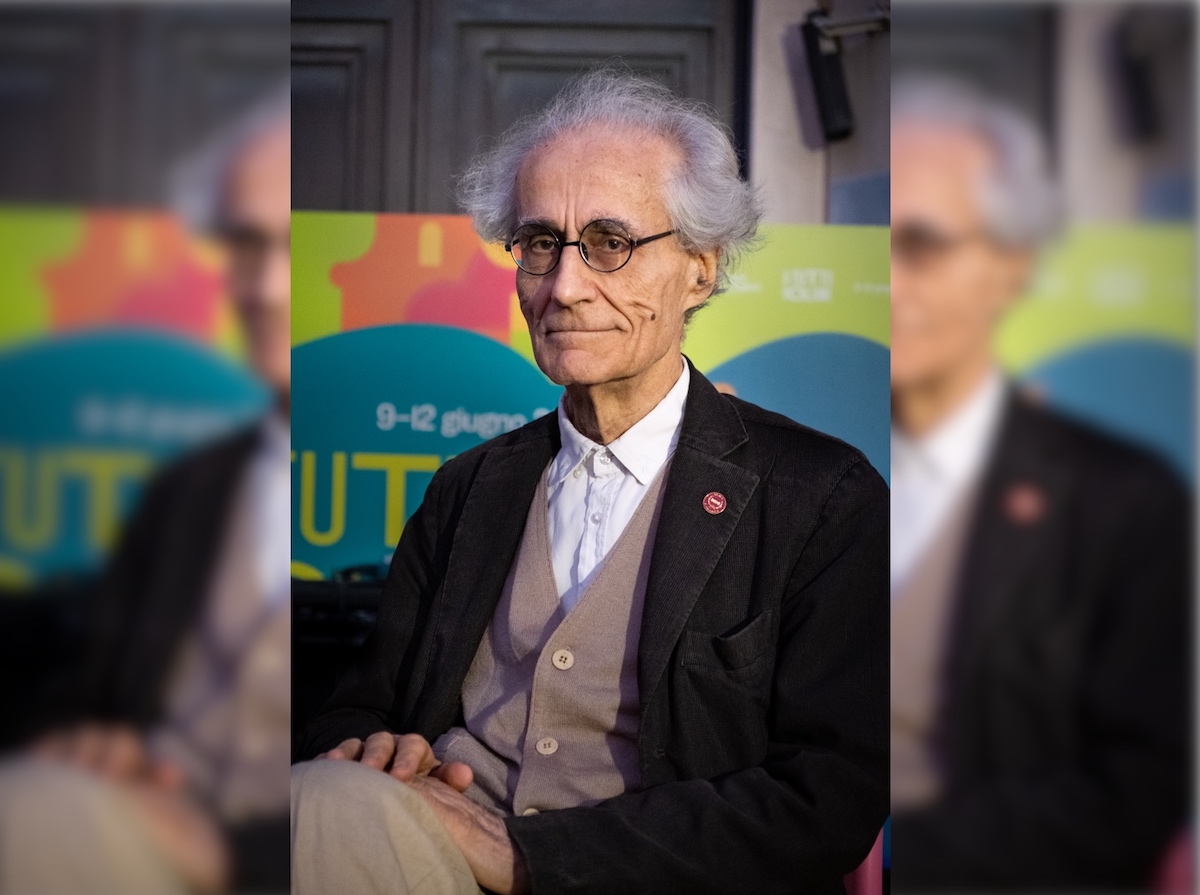

En Italie, le procès de Luciano Canfora attendu en octobre

À Bari, une audience préliminaire très attendue s'est déroulée ce mardi 16 avril, en présence de l'accusé, l'historien Luciano Canfora. Attaqué pour diffamation après avoir qualifié la Première ministre Giorgia Meloni de « néonazie dans l'âme », il sera jugé le 7 octobre prochain.

16/04/2024, 16:36

À Mayotte, la chaine du livre face aux difficultés “permanentes”

À une intense crise de l'eau en 2023, a succédé, à Mayotte, une crise sociale, de grande ampleur également, consécutive à d'importants flux de population en provenance des Comores et de Madagascar, notamment. La chaine du livre de l’île, déjà fragile, se retrouve dans une situation délicate.

16/04/2024, 12:56

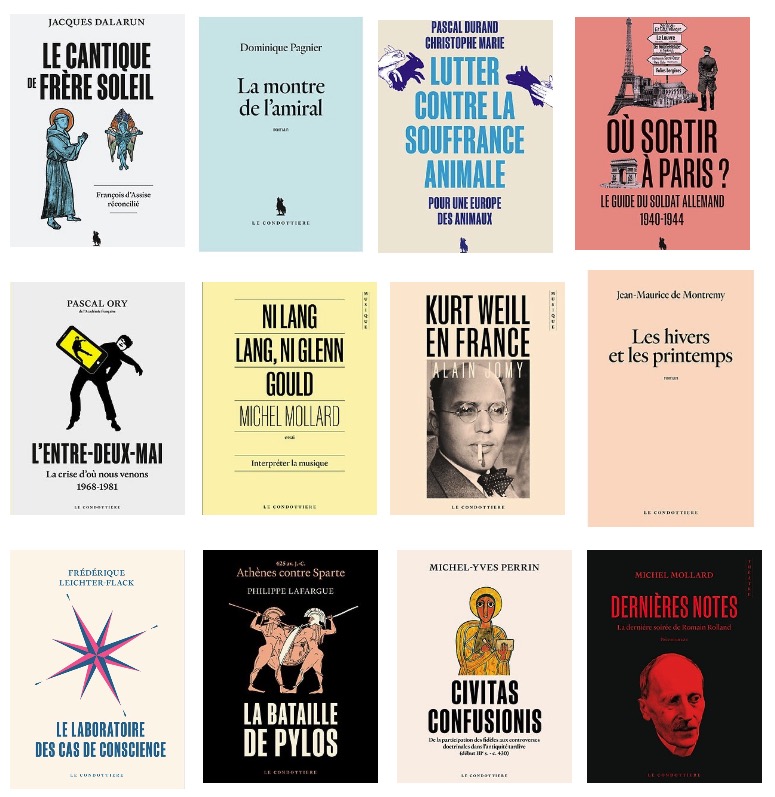

Le Condottière, un mercenaire dans l'édition

Avec plus d’une vingtaine de titres déjà au catalogue, les éditions Le Condottiere se spécialisent dans la publication d’ouvrages traitant des sciences humaines, de l’histoire et de la musique. Elles proposent également des témoignages, des romans et des pièces de théâtre et se placent bien entendu sous le patronage d’André Suarès et de son ouvrage Le Voyage du condottiere (paru à partir de 1910).

16/04/2024, 12:29

Décès de Bruno Combes, “révélation de l’autoédition française”

Bruno Combes, né en 1962, était un écrivain français reconnu pour ses romans d’amour et de suspense. Il est décédé ce 13 avril 2024, des suites d’une crise cardiaque, apprend ActuaLitté de son éditeur. Il avait commencé sa carrière littéraire relativement tard, mais il a rapidement gagné en popularité grâce à son style émotionnellement engageant et ses intrigues captivantes.

15/04/2024, 17:30

Plus grand que le ciel : Virginie Grimaldi et Olivier Adam de retour en mai

Virginie Grimaldi, qui a vendu en 2023 plus d’un million d’exemplaires de ses livres en France, est de retour ce 1er mai avec Plus grand que le ciel, qui paraît chez Flammarion. Son second roman dans la maison de Sophie de Closets après Une belle vie, paru l'année dernière. Toujours dans la même maison et le même, le nouveau Olivier Adam sort également, Il ne se passe jamais rien ici.

15/04/2024, 16:23

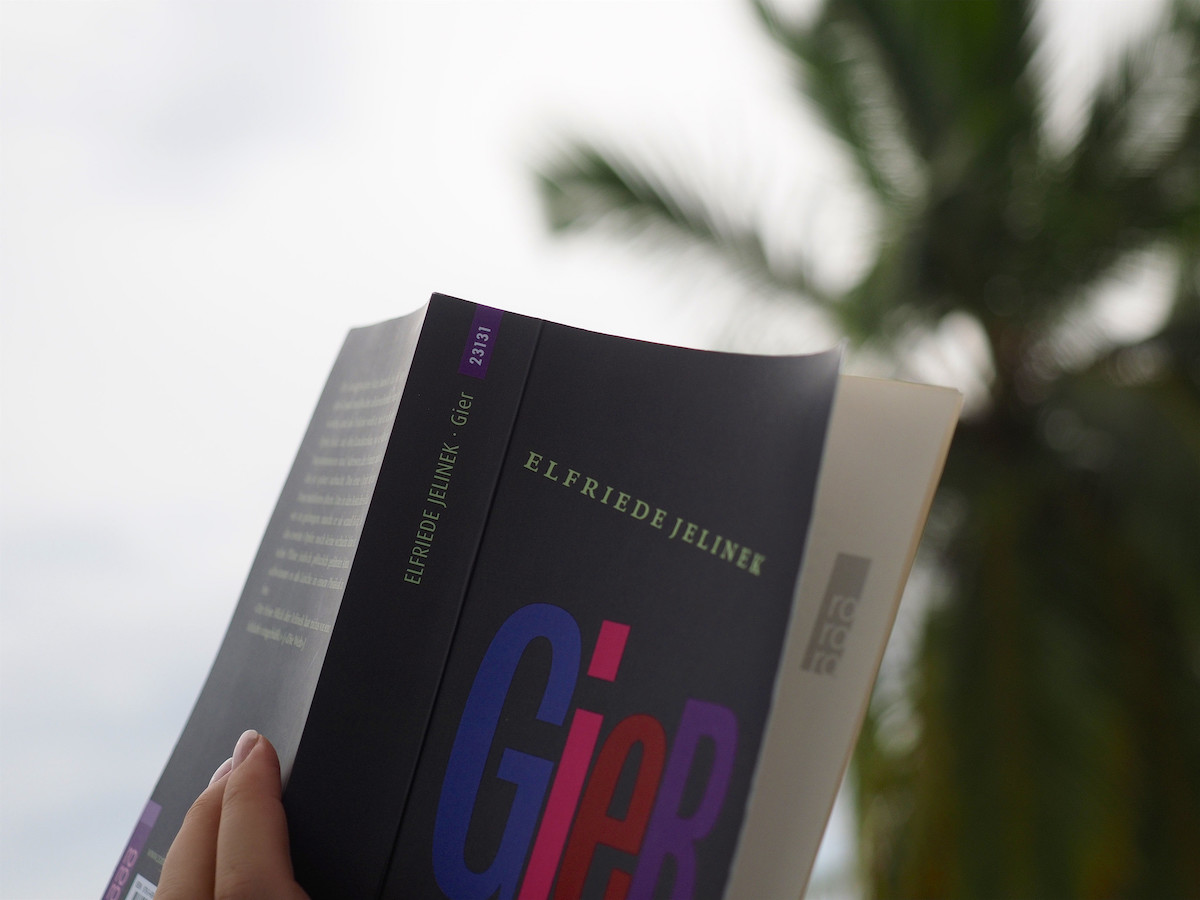

L'autrice autrichienne Elfriede Jelinek ordonnée Commandeur

L'autrice autrichienne Elfriede Jelinek a reçu ce dimanche 14 avril les insignes de Commandeur dans l'ordre des Arts et des Lettres, des mains de l'ambassadeur de France en Autriche, Gilles Pécout. Lauréate du Prix Nobel de littérature en 2004, cette romancière et dramaturge est publiée en France aux éditions du Seuil, Jacqueline Chambon et l'Arche.

15/04/2024, 15:46

Editis : Marie-Pierre Sangouard, cinquième directrice générale

Marie-Pierre Sangouard a été nommée par Denis Olivennes et Catherine Lucet à la tête d'Editis, en tant que nouvelle directrice générale adjointe du groupe. La directrice de la diffusion d'Interforum depuis 2018 intègre l'équipe de direction 100 % féminine, en tant que cinquième élément. Une belle promotion donc.

15/04/2024, 14:57

En Norvège, qui a voulu tuer l'éditeur des Versets sataniques ?

En 1993, William Nygaard, directeur de la maison d'édition norvégienne Aschehoug, reçoit trois balles devant son domicile, à Oslo. 25 ans plus tard, en 2018, deux personnes étaient arrêtées, accusées de tentative de meurtre avec préméditation. Le 9 avril dernier, le bureau du procureur d'Oslo a toutefois annoncé la clôture de la procédure, faute de preuves.

15/04/2024, 14:43

Murielle Magellan signe Danse ta vie, pour France 2

L'autrice, scénariste et réalisatrice Murielle Magellan signera pour France 2 le scénario d'un nouveau téléfilm, intitulé Danse ta vie. Elle s'inspirera pour ce long-métrage d'une idée de Jean-Pierre Améris, avec laquelle elle a déjà collaboré à plusieurs reprises.

15/04/2024, 14:11

Pourquoi opposer droits d’auteur et transition écologique ?

Lors du Festival du livre de Paris, Emmanuel Macron a annoncé une nouvelle mesure affectant le marché du livre d'occasion, qui consiste en une « contribution » destinée à « protéger le prix unique du livre neuf ». Les détails devaient être précisés par la ministre de la Culture, Rachida Dati, ce week-end, on attend d'ailleurs toujours... Les premiers visés par la décision du président : les plateformes de ventes d'ouvrages usagés. Maud Sarda, co-fondatrice et directrice générale de l'une d'entre elles, Label Emmaüs, réagit.

15/04/2024, 11:49

Les Mémoires posthumes d'Alexeï Navalny publiés par Robert Laffont

Mort le 16 février 2024 au centre pénitentiaire de Kharp à l'âge de 47 ans, Alexeï Navalny reste dans les mémoires comme l'un des plus fervents opposants à Vladimir Poutine. Il avait écrit, peu après son empoisonnement en 2020, un livre retraçant son parcours et les racines de son engagement contre l'autoritarisme installé en Russie depuis plusieurs années.

15/04/2024, 11:20

Le livre d'occasion en France : la grande étude

Pour rendre compte et comprendre les transformations du marché des livres d'occasion en France au cours de la dernière décennie, une vaste étude a été menée en 2022-2023 par le ministère de la Culture et la Sofia, sous la supervision du spécialiste du monde de l'édition, Bertrand Legendre. L'objectif : quantifier et comprendre ce secteur de la seconde main, en plein essor.

12/04/2024, 18:05

Books By Women : le métier évolue, surtout ne pas se perdre en route

Avril signe le retour des beaux jours, l'impératifs de ne pas se découvrir d'un fil, mais surtout des nouvelles de la lettre Books By Women. Et comme toujours, la voici proposée en intégralité, rien que pour vos yeux, comme dirait l'autre...

12/04/2024, 17:17

2023, l'ère des lecteurs multimédias et multisupports ?

La Sofia, le SNE et la SGDL ont dévoilé les résultats de la 13ème édition du baromètre des usages du livre, qui couvre les formats imprimés, numériques et audio. Réalisée par Médiamétrie au début de 2024, cette enquête examine les comportements d'achat et de lecture des Français âgés de 15 ans et plus pour l'année 2023.

12/04/2024, 16:36

Emmanuel Macron : "une contribution" prélevée sur le livre d'occasion

Lors de sa visite au Festival du livre de Paris qui s'est ouvert ce vendredi, le président Emmanuel Macron a annoncé l'introduction d'une nouvelle mesure pour préserver la loi sur le prix unique du livre neuf face à la concurrence croissante du marché du livre d'occasion.

12/04/2024, 15:33

En 2023, moins de livres achetés, plus d'argent engrangé

À l'occasion de l'inauguration du Festival du livre ce vendredi 12 avril au Grand Palais éphémère à Paris, le ministère de la Culture diffuse les « chiffres-clés de 2023 » relatifs au monde du livre et de l'édition, issus des analyses d'Electre Data Services, Kantar, GfK Market Intelligence, de l'Observatoire de l'économie du livre, du service du livre et de la lecture, de la direction générale des médias et des industries culturelles, ainsi que du Ministère de la Culture.

12/04/2024, 14:42

Rachida Dati : encourager la lecture avec des bibliothèques en HLM

Dans le cadre d'une démarche visant à renforcer l'accès à la lecture, en particulier parmi les jeunes, la ministre de la Culture, Rachida Dati, a révélé un projet innovant : établir des librairies et des bibliothèques au sein des logements sociaux et des zones rurales défavorisées. Cette annonce fait suite à l'étude récente du Centre national du livre qui signale une diminution alarmante de l'intérêt pour la lecture chez les jeunes français, particulièrement entre 16 et 19 ans, de plus en plus captivés par les écrans...

12/04/2024, 12:00

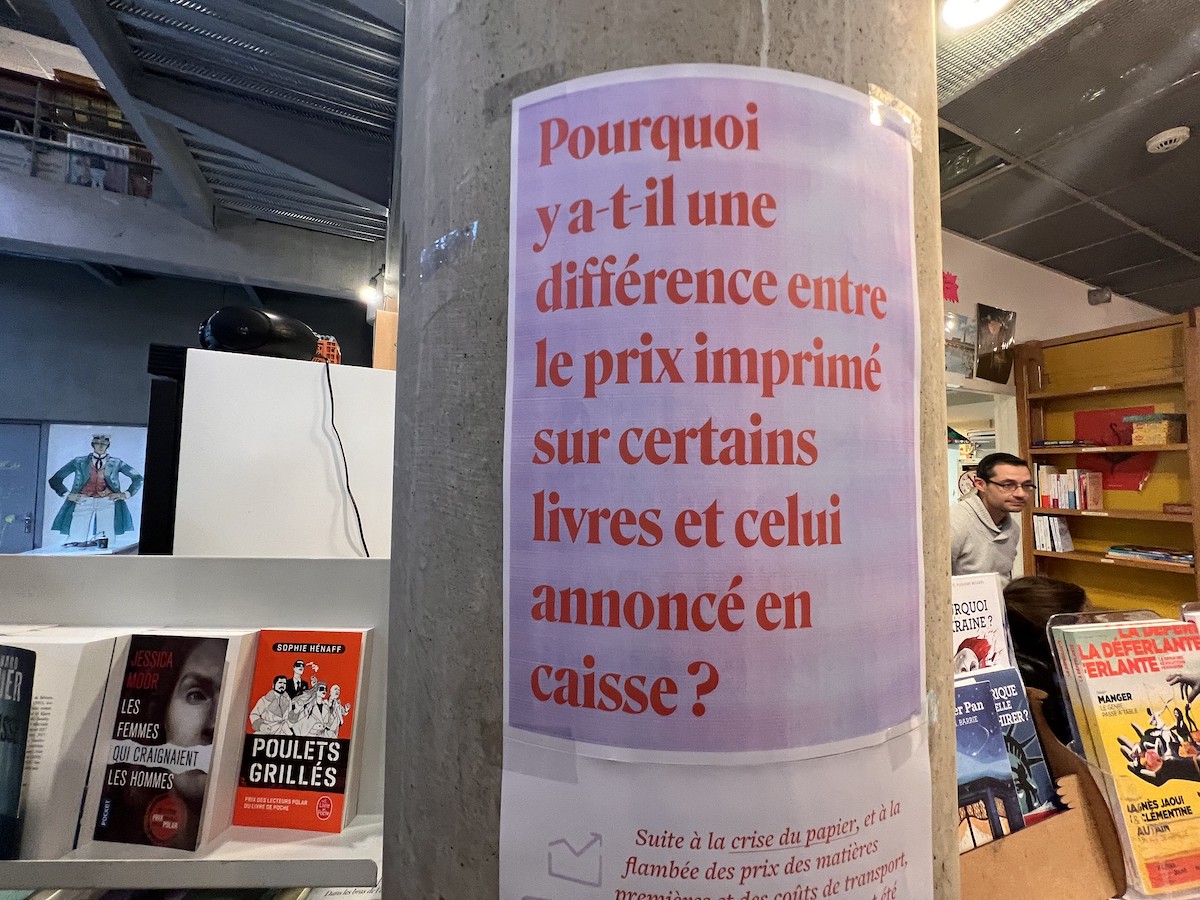

Modification du prix du livre : éditeurs et libraires fixent des règles

La fin d'année 2022 et les premiers mois de 2023 ont marqué la chaine du livre avec des hausses de prix inédites, consécutives à des problématiques d'approvisionnement et à la pénurie de papier. Les libraires s'étaient retrouvés forcés de réétiqueter au plus vite... Pour éviter d'autres situations similaires, les professions ont adopté une charte, à l'occasion du Festival du Livre de Paris.

11/04/2024, 19:30

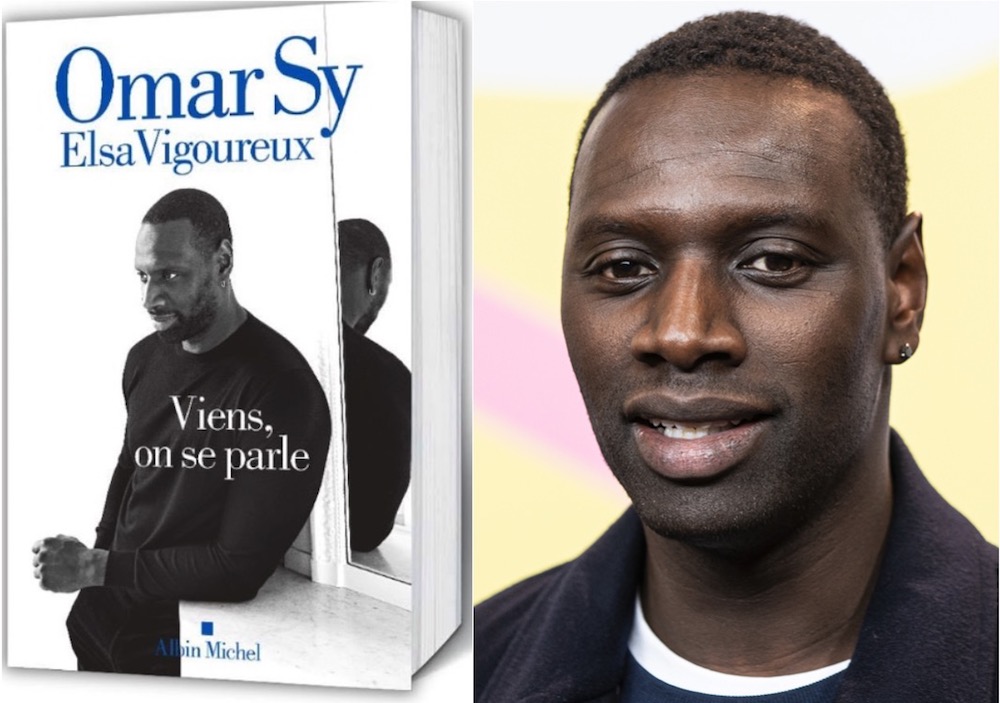

Omar Sy va sortir un livre, Viens, on se parle

L'acteur français a échangé pendant trois ans avec une journaliste du Nouvel Obs, Elsa Vigoureux. En ressort près de 300 pages d'entretien fleuve dans lequel Omar Sy est présenté comme « un nomade, un pionnier, un homme profond et libre, doué d’une insatiable curiosité ».

11/04/2024, 17:05

Enrichissement et conversion : Cairn.info fait l'acquisition d'Isako

Cairn.info, portail dédié aux sciences humaines et sociales, fait part de l'acquisition de la société Isako, spécialisée dans l'enrichissement sémantique et la conversion de documents. Un rapprochement « gage de performance et d’innovation », auquel le développement de l'intelligence artificielle n'est pas étranger.

11/04/2024, 16:52

Disparition de Trina Robbins, autrice et militante des comix

L'autrice Trina Robbins, fière militante féministe et grande pionnière des comix — la BD américaine underground — s'est éteinte ce 10 avril à l'âge de 85 ans. Hospitalisée depuis plusieurs semaines, Robbins laisse derrière elle l'héritage d'une série culte collaborative, Wimmen’s Comix, ainsi que de nombreuses adeptes, qui la citent volontiers comme mentor.

11/04/2024, 14:50

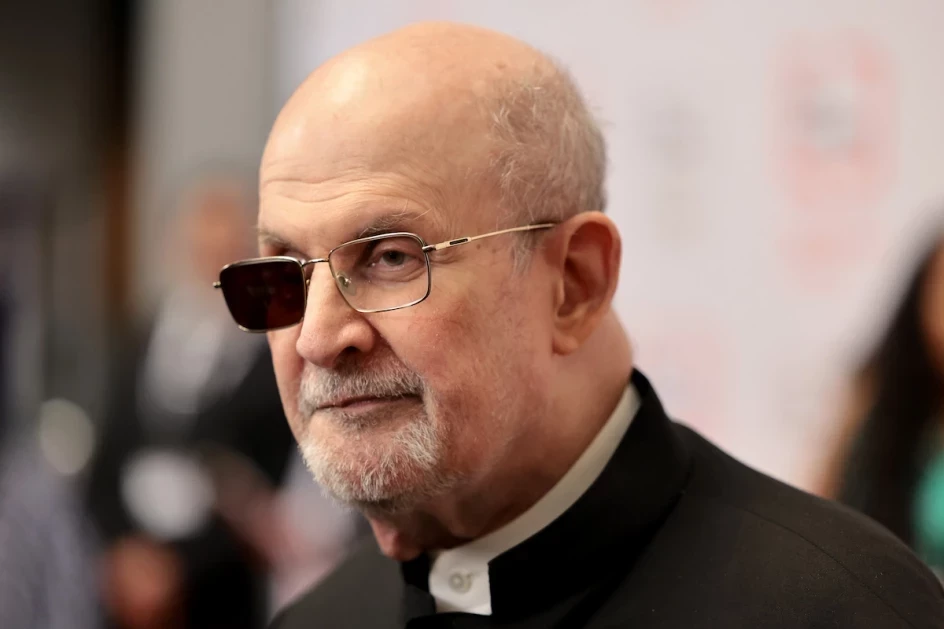

Salman Rushdie : le riche destin d'un enfant indien

Salman Rushdie, écrivain et symbole international de la lutte pour la liberté d'expression, a accordé une série d'entretien au journaliste de France Culture Christophe Ono-dit-Biot. Au cours de 5 épisodes de 30 minutes, diffusés dès le 15 avril, l'auteur des Versets sataniques revient sur le destin riche en rebondissements qui est le sien.

11/04/2024, 11:42

Meloni “néonazie dans l'âme” : l'historien Luciano Canfora en procès

En Italie, est-il encore possible d'appeler un chat un chat ? Pour avoir déclaré que Giorgia Meloni, présidente du Conseil des ministres italien, était « néonazie dans l'âme », l'historien italien Luciano Canfora a écopé d'une plainte pour diffamation. Une audience préliminaire est fixée au 16 avril prochain.

11/04/2024, 11:39

"La plus petite librairie du monde" a ouvert en avril

Depuis le 4 avril, la commune de quelque 2000 habitants, Hesdin, dans les Hauts-de-France, accueille « la plus petite librairie du monde », qui s’installe dans la maison natale de l’abbé Prévost, auteur du classique du XVIIIe siècle, Manon Lescaut. Un projet porté par Isabelle Baudelet, créatrice de la micro-entreprise d’édition, La Fabrique Poétique, et Pauline et Franck Groux, conteuse et arrière-petite-fille de Victor Segalen pour la première, et céramiste pour le second.

10/04/2024, 17:58

Commenter cet article